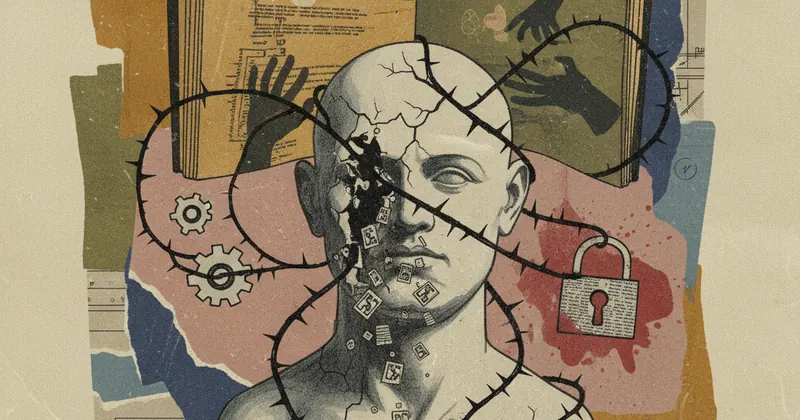

Litellm पर मैलवेयर हमले के बाद सुरक्षा अनुपालन की बड़ी चिंता

ओपन-सोर्स LLM फ्रेमवर्क Litellm को हाल ही में मैलवेयर हमले का सामना करना पड़ा, जिससे सुरक्षा अनुपालन (Security Compliance) पर गंभीर सवाल खड़े हो गए हैं। इस घटना ने AI प्रोजेक्ट्स में थर्ड-पार्टी कोड के उपयोग के जोखिमों को उजागर किया है।

Litellm मैलवेयर हमले के बाद AI सुरक्षा पर सवाल

शॉर्टकट में पूरी खबर

कही अनकही बातें

ओपन-सोर्स मॉडल सुरक्षा की सुविधा देते हैं, लेकिन उनकी समीक्षा (Review) न करना एक बड़ा जोखिम है।

समाचार विस्तार में पूरी खबर

Intro: हाल ही में, ओपन-सोर्स LLM फ्रेमवर्क Litellm में एक गंभीर मैलवेयर (Malware) पाया गया है, जिसने AI कम्युनिटी में हड़कंप मचा दिया है। यह घटना सॉफ्टवेयर सप्लाई चेन सुरक्षा (Software Supply Chain Security) की कमजोरियों को फिर से सामने लाती है, खासकर उन AI प्रोजेक्ट्स के लिए जो तेजी से थर्ड-पार्टी कंपोनेंट्स पर निर्भर हो रहे हैं। भारत जैसे देश में, जहाँ AI एडॉप्शन तेजी से बढ़ रहा है, यह खबर डेवलपर्स और कंपनियों के लिए एक चेतावनी है कि वे अपने सिस्टम की सुरक्षा को लेकर कितने सतर्क हैं।

मुख्य जानकारी (Key Details)

Litellm, जो कि LLM एप्लीकेशन बनाने के लिए एक लोकप्रिय प्रॉक्सी लेयर है, के कुछ वर्जन्स में दुर्भावनापूर्ण कोड (Malicious Code) की उपस्थिति की पुष्टि हुई है। सुरक्षा शोधकर्ताओं ने पाया कि हमलावरों ने इस फ्रेमवर्क में एक बैकडोर (Backdoor) डाला था, जिसका उपयोग संवेदनशील डेटा तक पहुँचने या सिस्टम को नियंत्रित करने के लिए किया जा सकता था। यह हमला मुख्य रूप से उन कंपनियों को प्रभावित करता है जो अपने प्रोडक्ट्स में LLM क्षमताओं को एकीकृत कर रहे हैं। Litellm के मेंटेनर्स ने तेजी से पैच (Patch) जारी किए हैं, लेकिन कई यूज़र्स अभी भी पुराने वर्जन्स का उपयोग कर रहे होंगे, जो जोखिम में हैं। यह घटना एक बड़ी चिंता का विषय है क्योंकि AI इकोसिस्टम में ओपन-सोर्स कंपोनेंट्स का उपयोग व्यापक है।

तकनीकी विवरण (Technical Insight)

मैलवेयर को आमतौर पर एक निर्भरता (Dependency) के माध्यम से इंजेक्ट किया गया था, जो कि एक सामान्य तरीका है जिसे 'Dependency Confusion' या 'Typosquatting' हमलों में इस्तेमाल किया जाता है। सुरक्षा अनुपालन (Security Compliance) के दृष्टिकोण से, यह दर्शाता है कि केवल मुख्य कोड की जाँच करना पर्याप्त नहीं है; पूरी निर्भरता ट्री (Dependency Tree) की निरंतर निगरानी आवश्यक है। Litellm के मामले में, हमलावरों ने कोड की समीक्षा (Code Review) प्रक्रियाओं को बायपास करने का प्रयास किया, जिससे यह स्पष्ट होता है कि AI डेवलपमेंट लाइफसाइकिल में सुरक्षा परीक्षण (Security Testing) को शुरुआत से ही शामिल करना कितना महत्वपूर्ण है।

भारत और यूजर्स पर असर (Impact on India)

भारत में AI स्टार्टअप्स और बड़ी टेक कंपनियां तेजी से LLM तकनीकों को अपना रही हैं। Litellm जैसे फ्रेमवर्क का उपयोग करने वाली भारतीय फर्मों को तुरंत अपने सिस्टम की जाँच करनी चाहिए। यदि डेटा या ग्राहक जानकारी इन कमजोर फ्रेमवर्क्स के माध्यम से प्रोसेस की जा रही थी, तो डेटा ब्रीच (Data Breach) का खतरा बढ़ जाता है। यह घटना भारत सरकार और इंडस्ट्री को AI सुरक्षा मानकों (AI Security Standards) को मजबूत करने के लिए प्रेरित कर सकती है, ताकि देश की डिजिटल अर्थव्यवस्था सुरक्षित रहे।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

Litellm एक ओपन-सोर्स LLM प्रॉक्सी (Proxy) फ्रेमवर्क है जो डेवलपर्स को विभिन्न लार्ज लैंग्वेज मॉडल्स (LLMs) के साथ आसानी से इंटरैक्ट करने में मदद करता है।

इस हमले ने थर्ड-पार्टी कोड में मैलवेयर इंजेक्ट होने के जोखिमों और AI सप्लाई चेन की कमजोरियों को उजागर किया है।

डेवलपर्स को अपने प्रोजेक्ट्स में उपयोग की जाने वाली सभी थर्ड-पार्टी लाइब्रेरीज़ और डिपेंडेंसीज़ का गहन सुरक्षा ऑडिट (Security Audit) करना चाहिए।