OpenAI का नया सुरक्षा कदम: AI मॉडल्स को सुरक्षित बनाने की तैयारी

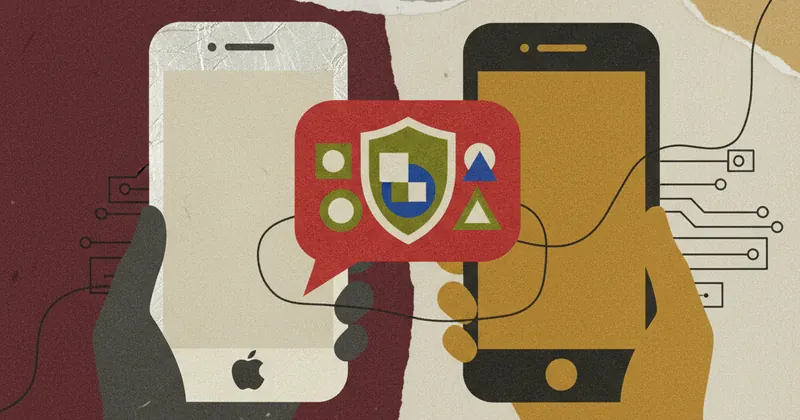

OpenAI ने अपने AI मॉडल्स की सुरक्षा और गोपनीयता को मजबूत करने के लिए 'Daybreak' नामक एक नई पहल की शुरुआत की है। इस कदम का उद्देश्य उभरते हुए साइबर खतरों से तकनीक को सुरक्षित रखना है।

OpenAI की नई सुरक्षा पहल की शुरुआत।

शॉर्टकट में पूरी खबर

कही अनकही बातें

सुरक्षा हमारी प्राथमिकता है और हम AI के भविष्य को सुरक्षित बनाने के लिए प्रतिबद्ध हैं।

समाचार विस्तार में पूरी खबर

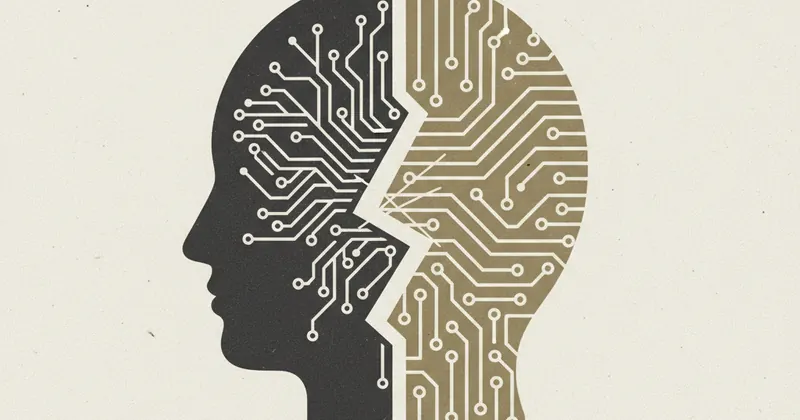

Intro: दुनिया की सबसे बड़ी AI कंपनियों में से एक, OpenAI ने हाल ही में अपने मॉडल्स की सुरक्षा को लेकर एक बड़ा ऐलान किया है। 'Daybreak' नाम की इस नई पहल का मुख्य उद्देश्य आर्टिफिशियल इंटेलिजेंस (AI) के बढ़ते इस्तेमाल के बीच डेटा की सुरक्षा को सुनिश्चित करना है। यह कदम तब उठाया गया है जब पूरी दुनिया में AI के दुरुपयोग और साइबर हमलों को लेकर चिंताएं बढ़ रही हैं। OpenAI का यह प्रयास न केवल उनकी तकनीक को मजबूत करेगा, बल्कि भविष्य के लिए एक मानक भी स्थापित करेगा।

मुख्य जानकारी (Key Details)

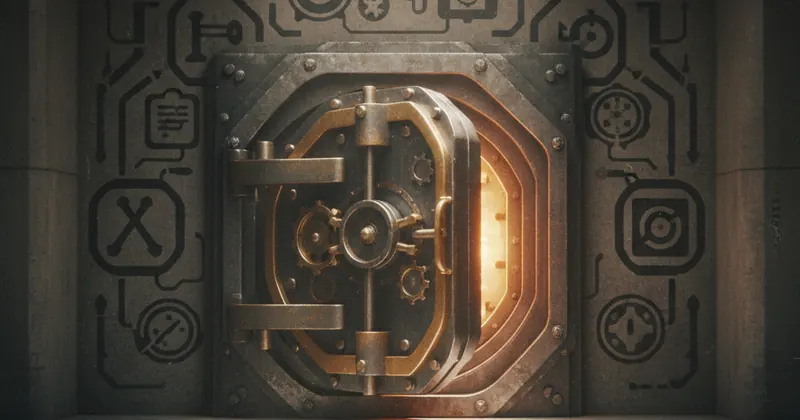

OpenAI की इस नई रणनीति के तहत, कंपनी अपने एल्गोरिदम (Algorithm) में ऐसे सुरक्षा फीचर्स जोड़ रही है जो संभावित खतरों को रीयल-टाइम में पहचान सकते हैं। 'Daybreak' पहल के अंतर्गत, कंपनी उन खतरों पर विशेष ध्यान दे रही है जो AI मॉडल्स के जरिए गलत सूचना फैलाने या संवेदनशील डेटा निकालने का प्रयास करते हैं। इसके अलावा, OpenAI ने एक नई सुरक्षा टीम का गठन किया है, जो चौबीसों घंटे सिस्टम की मॉनिटरिंग करेगी। कंपनी का कहना है कि यह सुरक्षा लेयर आने वाले समय में GPT-5 जैसे बड़े मॉडल्स के लिए एक सुरक्षा कवच की तरह काम करेगी। यह डेटा एनक्रिप्शन और बेहतर एक्सेस कंट्रोल के जरिए यूज़र्स की प्राइवेसी को एक नया आयाम देने का प्रयास है।

तकनीकी विवरण (Technical Insight)

यह सुरक्षा सिस्टम मशीन लर्निंग (Machine Learning) और एडवांस्ड थ्रेट डिटेक्शन (Threat Detection) तकनीक पर आधारित है। यह सिस्टम नेटवर्क पर होने वाली संदिग्ध गतिविधियों को ट्रैक करता है और उसे तुरंत ब्लॉक करने में सक्षम है। इसमें ऑटोमेटेड रिस्पॉन्स सिस्टम का इस्तेमाल किया गया है, जो किसी भी प्रकार के अनधिकृत एक्सेस (Unauthorized Access) को रोकने के लिए तुरंत एक्शन लेता है। यह तकनीक AI के ट्रेनिंग डेटा को भी सुरक्षित रखती है ताकि बाहरी हस्तक्षेप न हो सके।

भारत और यूजर्स पर असर (Impact on India)

भारत में OpenAI के करोड़ों यूज़र्स हैं, जो ChatGPT और अन्य सेवाओं का उपयोग करते हैं। इस सुरक्षा अपडेट के बाद, भारतीय यूज़र्स का व्यक्तिगत डेटा अब पहले से कहीं अधिक सुरक्षित हो जाएगा। साइबर धोखाधड़ी के बढ़ते मामलों के बीच, OpenAI का यह कदम भारत जैसे डिजिटल रूप से जागरूक देश के लिए बहुत महत्वपूर्ण है। इससे भारतीय डेवलपर्स और कंपनियों को भी अपने AI प्रोजेक्ट्स में उच्च सुरक्षा मानकों को अपनाने की प्रेरणा मिलेगी, जिससे देश का पूरा टेक इकोसिस्टम (Tech Ecosystem) सुरक्षित हो सकेगा।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

यह एक ऐसी पहल है जो AI मॉडल्स को बाहरी खतरों और डेटा चोरी से बचाने के लिए बनाई गई है।

हाँ, इससे यूज़र्स का डेटा अधिक सुरक्षित रहेगा और AI का उपयोग करना सुरक्षित होगा।

OpenAI इसे चरणों में लागू कर रहा है, जो धीरे-धीरे सभी प्लेटफॉर्म्स पर उपलब्ध होगा।