US कोर्ट सिस्टम में AI का इस्तेमाल: डेटा प्राइवेसी पर बड़ा सवाल

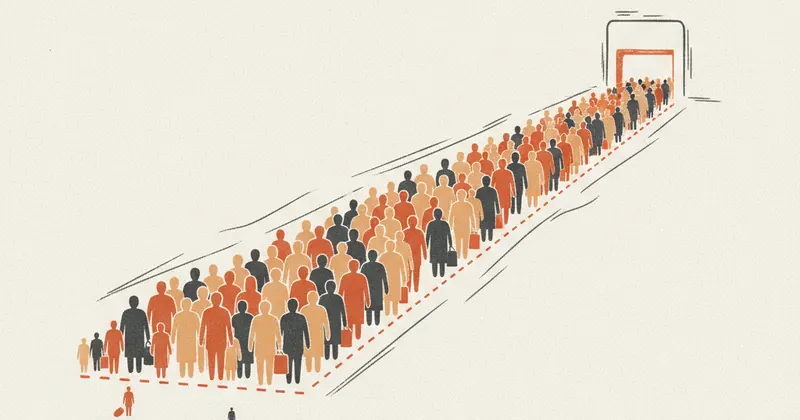

अमेरिकी कोर्ट सिस्टम में आर्टिफिशियल इंटेलिजेंस (AI) का इस्तेमाल शुरू हो गया है, जिससे डेटा प्राइवेसी और निष्पक्षता को लेकर गंभीर चिंताएं पैदा हो गई हैं। Minnesota जैसे राज्यों में AI टूल्स का उपयोग केस मैनेजमेंट और डॉक्यूमेंट रिव्यू के लिए किया जा रहा है, लेकिन इसके पीछे की कार्यप्रणाली अस्पष्ट है।

US कोर्ट सिस्टम में AI का इस्तेमाल

शॉर्टकट में पूरी खबर

कही अनकही बातें

जब हम अदालतों में AI का उपयोग करते हैं, तो हमें यह सुनिश्चित करना होगा कि एल्गोरिथम निष्पक्ष हो और डेटा सुरक्षित रहे।

समाचार विस्तार में पूरी खबर

Intro: अमेरिका के न्यायिक सिस्टम में आर्टिफिशियल इंटेलिजेंस (AI) का दखल तेजी से बढ़ रहा है, जिसने प्रौद्योगिकी और कानून के संगम पर महत्वपूर्ण सवाल खड़े किए हैं। Minnesota जैसे राज्यों में, कोर्ट्स अब केस मैनेजमेंट और डॉक्यूमेंट रिव्यू के लिए AI टूल्स का इस्तेमाल कर रहे हैं। हालांकि, यह दक्षता बढ़ाने का वादा करता है, लेकिन डेटा प्राइवेसी, पारदर्शिता और एल्गोरिथम पूर्वाग्रह (Algorithmic Bias) को लेकर गंभीर चिंताएं पैदा हो गई हैं। यह बदलाव भारतीय कानूनी और तकनीकी परिदृश्य के लिए भी एक महत्वपूर्ण चेतावनी है कि कैसे AI को संवेदनशील सार्वजनिक क्षेत्रों में लागू किया जाना चाहिए।

मुख्य जानकारी (Key Details)

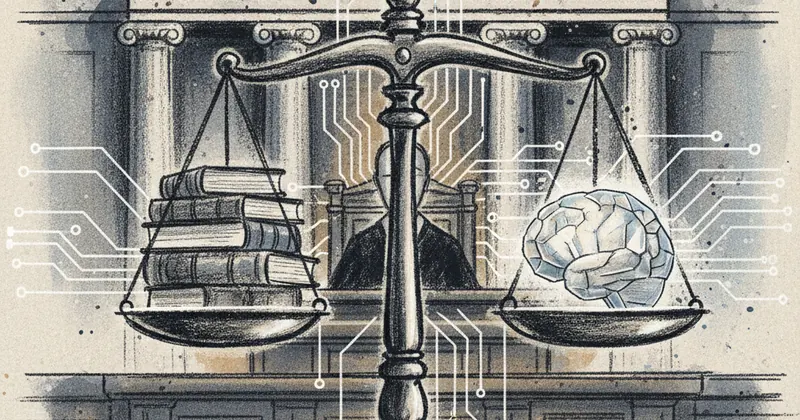

Wired की रिपोर्ट के अनुसार, US कोर्ट सिस्टम में AI का इंटीग्रेशन एक जटिल प्रक्रिया बन गया है। विशेष रूप से, Minnesota में, कोर्ट्स ने AI-आधारित सिस्टम्स को अपनाया है जो कानूनी दस्तावेजों को स्कैन और वर्गीकृत करते हैं। इन सिस्टम्स का मुख्य उद्देश्य मैन्युअल श्रम को कम करना और न्यायिक प्रक्रिया को तेज करना है। हालांकि, इन AI टूल्स के पीछे के एल्गोरिदम अक्सर 'ब्लैक बॉक्स' बने रहते हैं, जिसका अर्थ है कि निर्णय कैसे लिए गए, यह समझना मुश्किल है। यह पारदर्शिता की कमी तब बड़ी समस्या बन जाती है जब यह नागरिकों के मौलिक अधिकारों और डेटा सुरक्षा से जुड़ा हो। कानूनी विशेषज्ञों का मानना है कि यदि AI सिस्टम्स में ट्रेनिंग डेटा पक्षपाती (Biased) है, तो यह निष्पक्ष सुनवाई के सिद्धांत को खतरे में डाल सकता है, जिससे कुछ समूहों के खिलाफ भेदभाव हो सकता है।

तकनीकी विवरण (Technical Insight)

ये AI सिस्टम आमतौर पर नेचुरल लैंग्वेज प्रोसेसिंग (NLP) और मशीन लर्निंग (ML) मॉडल्स का उपयोग करते हैं। ये मॉडल कानूनी दस्तावेजों से प्रमुख डेटा पॉइंट्स, जैसे कि पार्टियाँ, तारीखें, और प्रासंगिक कानूनी धाराएँ निकालने के लिए प्रशिक्षित किए जाते हैं। चुनौती यह है कि इन मॉडलों को कैसे सत्यापित किया जाए कि वे सभी डेटा को समान रूप से और बिना किसी अंतर्निहित पूर्वाग्रह के संसाधित कर रहे हैं। डेटा स्टोरेज और सुरक्षा भी एक बड़ी चिंता है, क्योंकि कोर्ट के रिकॉर्ड में अत्यधिक संवेदनशील व्यक्तिगत जानकारी होती है। यदि ये AI प्लेटफॉर्म क्लाउड-आधारित हैं, तो डेटा एन्क्रिप्शन और एक्सेस कंट्रोल प्रोटोकॉल की कठोरता पर सवाल उठते हैं।

भारत और यूजर्स पर असर (Impact on India)

भारत में भी न्यायिक और सरकारी प्रक्रियाओं में AI के उपयोग पर चर्चा हो रही है। US कोर्ट सिस्टम में हो रहे विवाद हमें यह सबक सिखाते हैं कि AI को लागू करते समय डेटा गवर्नेंस और नैतिक दिशानिर्देशों का पालन करना अनिवार्य है। भारतीय यूज़र्स के लिए, यह एक रिमाइंडर है कि सरकारी सेवाओं में AI के प्रवेश पर कड़ी निगरानी की आवश्यकता है ताकि हमारी प्राइवेसी सुरक्षित रहे और तकनीक का उपयोग न्यायसंगत हो। तकनीकी संस्थानों को ऐसे AI समाधान विकसित करने पर ध्यान केंद्रित करना चाहिए जो न केवल कुशल हों बल्कि पूरी तरह से पारदर्शी और जवाबदेह भी हों।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

कोर्ट सिस्टम AI का उपयोग डॉक्यूमेंट्स को जल्दी प्रोसेस करने, केस मैनेजमेंट को बेहतर बनाने और न्यायिक प्रक्रियाओं को तेज करने के लिए कर रहा है।

AI सिस्टम्स संवेदनशील केस डेटा का विश्लेषण करते हैं, जिससे डेटा ब्रीच या अनधिकृत एक्सेस का खतरा बढ़ जाता है। साथ ही, डेटा का उपयोग कैसे किया जाता है, इसकी पारदर्शिता कम है।

हाँ, यदि AI सिस्टम को पुराने या पक्षपाती डेटा पर प्रशिक्षित किया जाता है, तो यह न्यायिक निर्णयों में पूर्वाग्रह (Bias) पैदा कर सकता है।