OpenAI का नया कदम: अब AI खुद रोकेगा साइबर हमले

OpenAI ने साइबर सुरक्षा को मजबूत करने के लिए एक नए AI मॉडल पर काम शुरू किया है। यह तकनीक भविष्य के साइबर हमलों को पहचानने और उन्हें रोकने में सक्षम होगी।

OpenAI का नया साइबर सुरक्षा मिशन

शॉर्टकट में पूरी खबर

कही अनकही बातें

साइबर सुरक्षा हमारे AI मिशन का एक अनिवार्य हिस्सा है, जिसे हम भविष्य के मॉडल्स में प्राथमिकता दे रहे हैं।

समाचार विस्तार में पूरी खबर

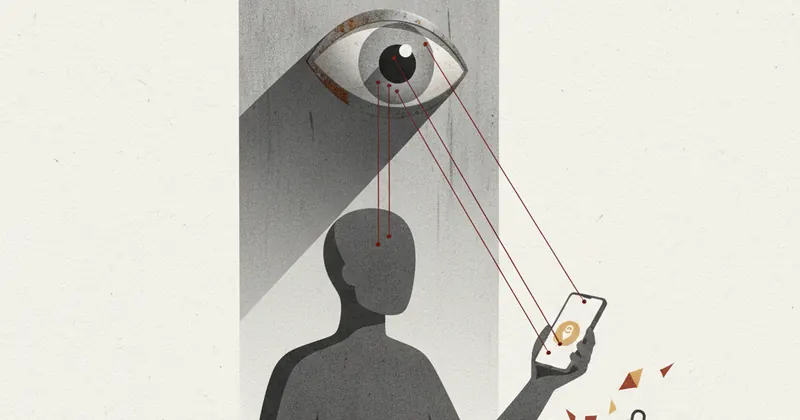

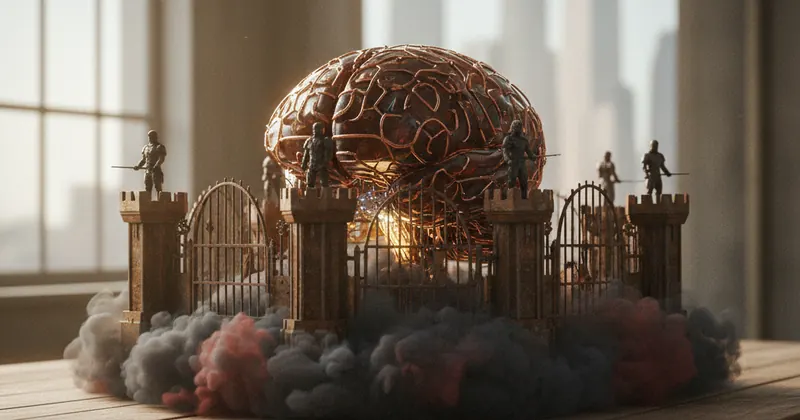

Intro: OpenAI ने हाल ही में अपने भविष्य के रोडमैप को स्पष्ट करते हुए साइबर सुरक्षा (Cybersecurity) पर अपना ध्यान केंद्रित किया है। कंपनी अब ऐसे AI मॉडल्स विकसित कर रही है जो न केवल कंटेंट जनरेट करेंगे, बल्कि जटिल साइबर हमलों को रोकने में भी सक्षम होंगे। यह कदम उस समय उठाया गया है जब दुनिया भर में AI-आधारित फिशिंग और डेटा चोरी के मामलों में भारी उछाल देखा जा रहा है। यह पहल डिजिटल दुनिया को अधिक सुरक्षित बनाने की दिशा में एक बड़ी क्रांति मानी जा रही है।

मुख्य जानकारी (Key Details)

OpenAI के सीईओ Sam Altman ने संकेत दिए हैं कि कंपनी के आगामी मॉडल्स, जिन्हें संभावित रूप से GPT-5 या उसके उन्नत वर्शन के रूप में देखा जा रहा है, उनमें 'सेल्फ-हीलिंग' कोड की क्षमता होगी। इसका अर्थ यह है कि यदि सिस्टम में कोई सुरक्षा खामी (Vulnerability) पाई जाती है, तो AI उसे खुद ही पैच कर सकेगा। कंपनी बड़े पैमाने पर साइबर डिफेंस रिसर्च में निवेश कर रही है ताकि हैकर्स द्वारा AI का गलत इस्तेमाल रोका जा सके। यह डेवलपमेंट न केवल व्यक्तिगत डेटा को बचाएगा, बल्कि कॉर्पोरेट और सरकारी स्तर पर भी सुरक्षा को एक नई मजबूती देगा।

तकनीकी विवरण (Technical Insight)

यह मॉडल मशीन लर्निंग (Machine Learning) के एडवांस एल्गोरिदम का उपयोग करके संदिग्ध नेटवर्क पैटर्न को स्कैन करता है। जब कोई अनधिकृत एक्सेस (Unauthorized Access) का प्रयास होता है, तो AI तुरंत उसे फ्लैग कर देता है और रियल-टाइम में प्रतिक्रिया देता है। यह सिस्टम लार्ज लैंग्वेज मॉडल्स (LLMs) की मदद से कोड के लॉजिक को समझता है और किसी भी मैलवेयर (Malware) को सक्रिय होने से पहले ही समाप्त करने की क्षमता रखता है।

भारत और यूजर्स पर असर (Impact on India)

भारत जैसे डिजिटल रूप से तेजी से बढ़ते देश के लिए यह तकनीक गेम-चेंजर साबित हो सकती है। भारतीय यूज़र्स अक्सर ऑनलाइन स्कैम और डेटा चोरी का शिकार होते हैं। OpenAI की यह नई सुरक्षा लेयर अगर भारतीय बैंकिंग और ई-कॉमर्स प्लेटफॉर्म्स के साथ इंटीग्रेट होती है, तो यह साइबर हमलों के जोखिम को काफी हद तक कम कर देगी। यह भारतीय स्टार्टअप्स को भी सुरक्षित इंफ्रास्ट्रक्चर बनाने में मदद करेगी, जिससे डिजिटल इंडिया का सपना और अधिक सुरक्षित बनेगा।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

यह पूरी तरह रोकने का दावा तो नहीं करता, लेकिन हमलों को पहचानने और उनके जोखिम को कम करने में काफी प्रभावी साबित होगा।

जी हाँ, यह तकनीक ChatGPT के भविष्य के वर्शन और OpenAI के अन्य टूल्स में सुरक्षा को बेहतर बनाने के लिए विकसित की जा रही है।

भारतीय यूज़र्स के लिए डेटा सुरक्षा और ऑनलाइन प्राइवेसी के स्तर में बढ़ोत्तरी होगी।