Anthropic पर बड़ा कानूनी एक्शन, सप्लाई चेन में AI जोखिम का आरोप

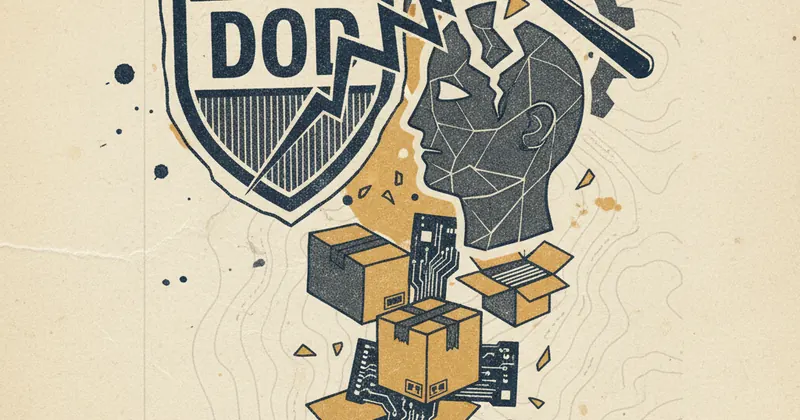

Anthropic के खिलाफ अमेरिकी रक्षा विभाग (DoD) ने एक बड़ा मुकदमा दायर किया है, जिसमें कंपनी पर सप्लाई चेन में गंभीर AI जोखिम उत्पन्न करने का आरोप लगाया गया है। यह मामला AI सुरक्षा और सरकारी कॉन्ट्रैक्ट्स के बीच तनाव को दर्शाता है।

Anthropic के खिलाफ DoD ने मुकदमा दायर किया।

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI सिस्टम्स की सुरक्षा सुनिश्चित करना राष्ट्रीय सुरक्षा के लिए अत्यंत महत्वपूर्ण है, और हम इस मामले में सख्त कार्रवाई करेंगे।

समाचार विस्तार में पूरी खबर

Intro: आर्टिफिशियल इंटेलिजेंस (AI) की दुनिया में सुरक्षा को लेकर बहस तेज हो गई है, क्योंकि अमेरिकी रक्षा विभाग (DoD) ने Anthropic जैसी प्रमुख AI कंपनी के खिलाफ एक बड़ा कानूनी कदम उठाया है। यह मुकदमा कंपनी पर सप्लाई चेन में AI मॉडल डिप्लॉयमेंट के दौरान गंभीर सुरक्षा जोखिम पैदा करने का आरोप लगाता है। यह घटना दर्शाती है कि कैसे AI टेक्नोलॉजी के तेजी से विस्तार के साथ उसके संभावित खतरों को लेकर चिंताएं बढ़ रही हैं, खासकर जब बात राष्ट्रीय सुरक्षा और संवेदनशील डेटा की हो।

मुख्य जानकारी (Key Details)

DoD ने यह मुकदमा दायर करते हुए दावा किया है कि Anthropic के कुछ AI सॉल्यूशंस, जिन्हें सरकारी सिस्टम्स में इंटीग्रेट किया गया था, वे अपेक्षित सुरक्षा मानकों का पालन नहीं करते। रिपोर्ट के अनुसार, इन मॉडल्स में संभावित रूप से ऐसे कमजोरियां हैं जिनका दुरुपयोग दुर्भावनापूर्ण एक्टर्स द्वारा किया जा सकता है। यह मामला विशेष रूप से AI सप्लाई चेन के उस हिस्से पर केंद्रित है जहां थर्ड-पार्टी वेंडर्स और इंटीग्रेटर्स शामिल होते हैं। यदि ये सिस्टम्स सुरक्षित नहीं होते हैं, तो यह न केवल डेटा की गोपनीयता के लिए खतरा है, बल्कि ऑपरेशनल अखंडता (Operational Integrity) को भी प्रभावित कर सकता है। DoD का कहना है कि Anthropic ने इन जोखिमों को ठीक से संबोधित नहीं किया, जिसके परिणामस्वरूप यह कानूनी कार्रवाई आवश्यक हो गई।

तकनीकी विवरण (Technical Insight)

इस विवाद का मुख्य बिंदु AI मॉडल की 'ट्रस्टवर्दीनेस' (Trustworthiness) है। जब कोई AI मॉडल सरकारी सिस्टम्स में उपयोग किया जाता है, तो उसे कठोर 'सिक्योरिटी प्रोटोकॉल्स' से गुजरना पड़ता है। मुकदमे में यह आरोप लगाया गया है कि Anthropic के कुछ मॉडल्स 'एडवर्सरियल अटैक' (Adversarial Attacks) के प्रति अधिक संवेदनशील हो सकते हैं। ये ऐसे हमले हैं जहां इनपुट डेटा में सूक्ष्म बदलाव करके AI को गलत आउटपुट देने के लिए मजबूर किया जा सकता है। DoD इन मॉडल्स की एंड-टू-एंड सिक्योरिटी ऑडिटिंग की मांग कर रहा है ताकि यह सुनिश्चित हो सके कि वे किसी भी तरह के सुरक्षा उल्लंघन से मुक्त हैं।

भारत और यूजर्स पर असर (Impact on India)

भले ही यह मामला सीधे तौर पर भारत से जुड़ा न हो, लेकिन यह वैश्विक स्तर पर AI गवर्नेंस और रेगुलेशन के लिए एक महत्वपूर्ण उदाहरण प्रस्तुत करता है। भारत भी अपने डिफेंस और सरकारी इंफ्रास्ट्रक्चर में AI को तेजी से अपना रहा है। इस मुकदमे से यह सबक मिलता है कि AI डेवलपर्स को अपने प्रोडक्ट की सुरक्षा और जवाबदेही को गंभीरता से लेना होगा। भारतीय टेक इंडस्ट्री के लिए यह एक रिमाइंडर है कि AI सॉल्यूशंस को लागू करते समय कठोर सुरक्षा उपायों (Security Measures) का पालन करना अनिवार्य है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

Anthropic पर आरोप है कि उसने अपने AI मॉडल्स को सप्लाई चेन में इस तरह से डिप्लॉय किया है, जिससे गंभीर सुरक्षा जोखिम उत्पन्न हो सकते हैं।

DoD चाहता है कि Anthropic अपने AI सिस्टम्स की सुरक्षा प्रक्रियाओं की समीक्षा करे और आवश्यक सुधार करे ताकि सप्लाई चेन सुरक्षित रहे।

यह मामला दिखाता है कि वैश्विक स्तर पर AI की सुरक्षा और सरकारी सिस्टम्स में उसके एकीकरण को लेकर चिंताएं बढ़ रही हैं।