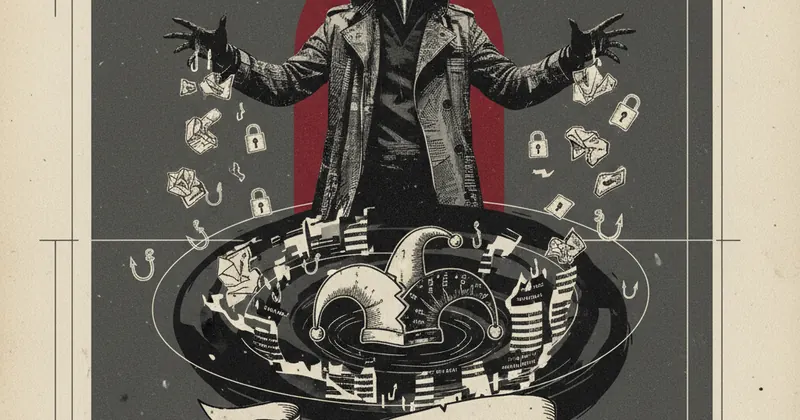

Trump का AI सुरक्षा प्लान: क्या तकनीक और सुरक्षा के बीच बनेगा तालमेल?

अमेरिका के नवनिर्वाचित राष्ट्रपति डोनाल्ड ट्रंप की ओर से AI मॉडल्स के लिए प्रस्तावित सुरक्षा परीक्षणों पर विशेषज्ञों ने चिंता जताई है। यह कदम वैश्विक तकनीक और सुरक्षा मानकों को पूरी तरह बदल सकता है।

ट्रंप का AI सुरक्षा प्लान और चुनौतियां।

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI सुरक्षा के लिए केवल परीक्षण काफी नहीं हैं, इसके लिए एक मजबूत नियामक ढांचे की आवश्यकता है।

समाचार विस्तार में पूरी खबर

Intro: डोनाल्ड ट्रंप का नया दृष्टिकोण AI मॉडल्स के सुरक्षा परीक्षणों को लेकर चर्चा का विषय बन गया है। अमेरिका की नई सरकार द्वारा प्रस्तावित ये कदम न केवल अमेरिकी कंपनियों के लिए बल्कि पूरी दुनिया के टेक्नोलॉजी इकोसिस्टम (Ecosystem) के लिए महत्वपूर्ण हैं। ट्रंप का प्रशासन AI की बढ़ती शक्ति पर नियंत्रण पाने के लिए कुछ नए मानक सेट करना चाहता है, ताकि भविष्य में होने वाले जोखिमों को कम किया जा सके। यह खबर इसलिए महत्वपूर्ण है क्योंकि दुनिया भर के देशों की नजरें इस पर टिकी हैं कि अमेरिका अपनी टेक पॉलिसी को कैसे आकार देता है।

मुख्य जानकारी (Key Details)

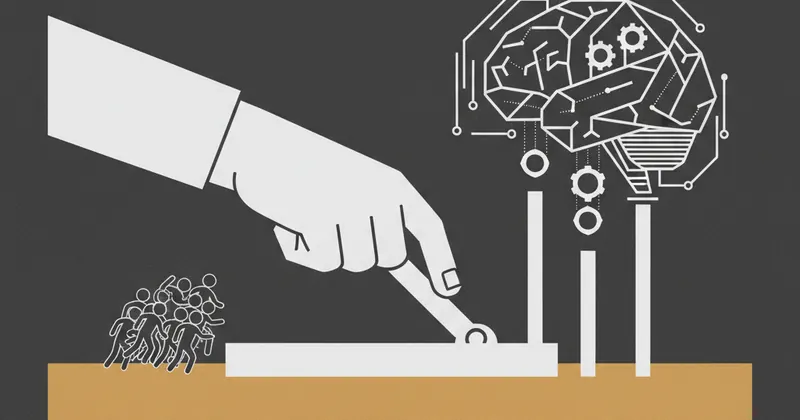

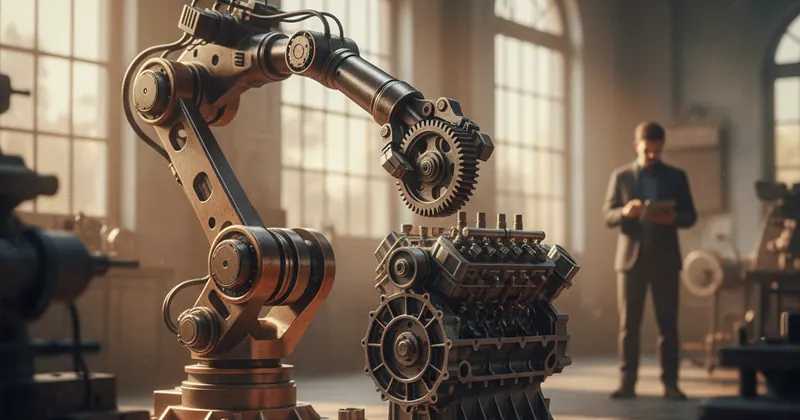

प्रस्तावित योजना के तहत, बड़ी टेक कंपनियों को अपने AI मॉडल्स को रिलीज करने से पहले कड़े सुरक्षा ऑडिट (Audit) से गुजरना होगा। विशेषज्ञों का तर्क है कि यदि ये परीक्षण सही ढंग से डिजाइन नहीं किए गए, तो इनका असर उल्टा हो सकता है। डेटा की गोपनीयता (Data Privacy) और एल्गोरिदम (Algorithm) की निष्पक्षता सुनिश्चित करना सबसे बड़ी चुनौती है। कई टेक दिग्गजों ने चेतावनी दी है कि यदि नियमों को बहुत अधिक सख्त बनाया गया, तो स्टार्टअप्स के लिए बाजार में टिकना मुश्किल हो जाएगा। यह स्थिति एक बड़े नीतिगत संघर्ष की ओर इशारा कर रही है जहाँ इनोवेशन और सुरक्षा आमने-सामने हैं।

तकनीकी विवरण (Technical Insight)

तकनीकी स्तर पर, यह परीक्षण प्रक्रिया जटिल है। इसमें 'रेड टीमिंग' (Red Teaming) का उपयोग किया जाएगा, जहाँ विशेषज्ञ AI को जानबूझकर गलत जानकारी देने या खतरनाक कोड लिखने के लिए उकसाते हैं। इसके अलावा, मॉडल के वेट (Model Weights) और ट्रेनिंग डेटा (Training Data) की सुरक्षा पर भी सवाल उठ रहे हैं। यदि इन मॉडल्स का सोर्स कोड लीक होता है, तो सुरक्षा के सारे दावे धरे के धरे रह जाएंगे। इसलिए, केवल परीक्षण ही पर्याप्त नहीं हैं, बल्कि एक सुरक्षित इंफ्रास्ट्रक्चर (Infrastructure) की जरूरत है।

भारत और यूजर्स पर असर (Impact on India)

भारत के लिए इसके दूरगामी परिणाम हो सकते हैं। चूँकि भारतीय कंपनियां और डेवलपर्स अमेरिकी AI प्लेटफॉर्म्स पर काफी निर्भर हैं, इसलिए अमेरिकी नियमों में बदलाव का सीधा असर हमारे मार्केट पर पड़ेगा। अगर अमेरिका में AI डेवलपमेंट की गति धीमी होती है, तो भारतीय टेक इंडस्ट्री को भी अपने टूल्स और स्ट्रैटेजी (Strategy) को बदलना पड़ सकता है। यह भारतीय डेवलपर्स के लिए एक अवसर भी हो सकता है कि वे स्थानीय स्तर पर सुरक्षित AI समाधान विकसित करें और वैश्विक मानकों में अपनी भागीदारी बढ़ाएं।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

हाँ, क्योंकि अमेरिकी नीतियां अक्सर वैश्विक स्तर पर AI मानकों को निर्धारित करती हैं जो भारतीय स्टार्टअप्स और कंपनियों को प्रभावित करती हैं।

ये वे प्रक्रियाएं हैं जिनसे यह सुनिश्चित किया जाता है कि AI मॉडल हानिकारक जानकारी न दें और सुरक्षित रूप से काम करें।

विशेषज्ञों को डर है कि जल्दबाजी में लाए गए नियम इनोवेशन को रोक सकते हैं या सुरक्षा में कमियां छोड़ सकते हैं।