OpenAI पर लगा मुकदमा: शूटिंग पीड़ित की पत्नी ने दायर किया केस

OpenAI के ChatGPT पर एक गंभीर कानूनी मुकदमा दर्ज किया गया है। आरोप है कि AI मॉडल ने गलत जानकारी देकर एक दुखद घटना को प्रभावित किया।

OpenAI के खिलाफ कानूनी केस की शुरुआत।

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI कंपनियों को अपने मॉडल्स द्वारा दी गई जानकारी की जिम्मेदारी लेनी होगी।

समाचार विस्तार में पूरी खबर

Intro: आर्टिफिशियल इंटेलिजेंस (AI) की दुनिया में OpenAI का नाम सबसे आगे है, लेकिन अब कंपनी एक बड़ी कानूनी मुसीबत में घिर गई है। हाल ही में, फ्लोरिडा स्टेट यूनिवर्सिटी में हुई एक शूटिंग घटना के पीड़ित की पत्नी ने OpenAI पर मुकदमा दायर किया है। यह मामला इस बात पर केंद्रित है कि कैसे ChatGPT ने गलत जानकारी प्रदान की, जिससे एक निर्दोष व्यक्ति के जीवन पर गंभीर प्रभाव पड़ा। यह खबर न केवल OpenAI के लिए, बल्कि पूरी टेक इंडस्ट्री के लिए एक चेतावनी है।

मुख्य जानकारी (Key Details)

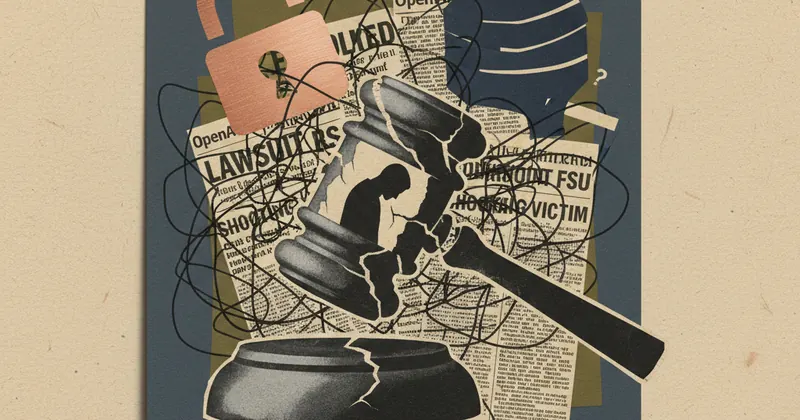

मुकदमे के अनुसार, ChatGPT ने एक ऐसी रिपोर्ट तैयार की जिसमें एक व्यक्ति का नाम गलत तरीके से शूटिंग से जोड़ दिया गया। यह जानकारी पूरी तरह से भ्रामक थी, जिसके कारण संबंधित व्यक्ति को भारी मानसिक और सामाजिक प्रताड़ना झेलनी पड़ी। पीड़ित पक्ष का तर्क है कि OpenAI का 'हैलुसिनेशन' (Hallucination) फीचर, जिसमें AI आत्मविश्वास के साथ गलत तथ्य पेश करता है, बेहद खतरनाक है। कंपनी की ओर से अभी तक कोई विस्तृत बयान नहीं आया है, लेकिन यह केस कोर्ट में AI की जवाबदेही तय करने के लिए एक बड़ा आधार बन सकता है।

तकनीकी विवरण (Technical Insight)

यह समस्या 'लार्ज लैंग्वेज मॉडल' (LLM) की कार्यप्रणाली से जुड़ी है। ChatGPT जैसे मॉडल्स इंटरनेट पर मौजूद डेटा को प्रोसेस करते हैं और पैटर्न के आधार पर जवाब देते हैं। यदि ट्रेनिंग डेटा में गलत जानकारी मौजूद है या मॉडल तथ्यों को समझने में चूक करता है, तो वह 'हैलुसिनेशन' की स्थिति में चला जाता है। इसमें AI किसी काल्पनिक घटना को भी सच की तरह पेश कर सकता है, जो कानूनी और नैतिक दृष्टिकोण से एक बड़ी चुनौती है।

भारत और यूजर्स पर असर (Impact on India)

भारत में भी ChatGPT और अन्य AI टूल्स का इस्तेमाल तेजी से बढ़ रहा है। यह घटना भारतीय यूज़र्स के लिए एक सीख है कि AI द्वारा दी गई किसी भी संवेदनशील जानकारी पर आंख मूंदकर भरोसा न करें। भविष्य में, यदि भारत सरकार AI रेगुलेशन (AI Regulation) पर कड़े नियम लागू करती है, तो कंपनियों को अपने एल्गोरिदम में पारदर्शिता (Transparency) लानी होगी। भारतीय यूज़र्स को सलाह दी जाती है कि महत्वपूर्ण कार्यों के लिए AI के तथ्यों को हमेशा क्रॉस-चेक करें।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

ChatGPT द्वारा गलत जानकारी देने के कारण एक व्यक्ति को गलत तरीके से आरोपी बनाया गया, जिसके बाद यह केस दायर हुआ है।

वर्तमान में कानून इस पर स्पष्ट नहीं है, लेकिन यह मुकदमा इस दिशा में एक बड़ा बदलाव ला सकता है।

कंपनियों को अब अपने AI मॉडल्स की सटीकता (Accuracy) पर अधिक ध्यान देना होगा।