AI पर बड़ा फैसला: Google, Microsoft और xAI अब US सरकार को देंगी एक्सेस

Google, Microsoft और xAI जैसी दिग्गज कंपनियों ने अमेरिकी सरकार के साथ एक महत्वपूर्ण समझौता किया है। इसके तहत ये कंपनियां अपने नए AI मॉडल्स को सरकारी सुरक्षा जांच के लिए उपलब्ध कराएंगी।

AI सुरक्षा के लिए सरकार और टेक कंपनियों में समझौता।

शॉर्टकट में पूरी खबर

कही अनकही बातें

यह समझौता एआई के सुरक्षित विकास की दिशा में एक ऐतिहासिक कदम है, जो पारदर्शिता और जवाबदेही सुनिश्चित करेगा।

समाचार विस्तार में पूरी खबर

Intro: आर्टिफिशियल इंटेलिजेंस (AI) की दौड़ में अब सुरक्षा सबसे बड़ा मुद्दा बन गई है। Google, Microsoft और Elon Musk की कंपनी xAI ने अमेरिकी सरकार के साथ एक महत्वपूर्ण एमओयू (MoU) साइन किया है। इस समझौते का मुख्य उद्देश्य यह है कि कंपनियां अपने नए AI मॉडल्स को मार्केट में उतारने से पहले सरकार को टेस्टिंग के लिए उपलब्ध कराएंगी। यह निर्णय AI के बढ़ते खतरों और उनसे जुड़ी चिंताओं को देखते हुए लिया गया है, ताकि समाज और तकनीक के बीच संतुलन बना रहे।

मुख्य जानकारी (Key Details)

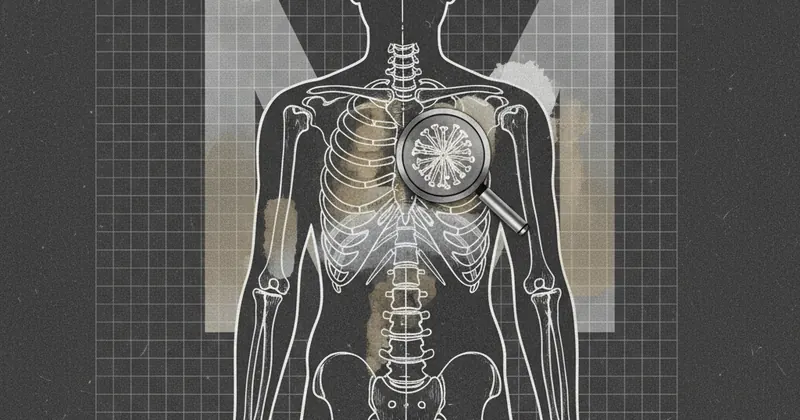

इस नई व्यवस्था के तहत, AI डेवलपर्स को यह सुनिश्चित करना होगा कि उनके मॉडल किसी भी प्रकार के हानिकारक कंटेंट, साइबर हमलों या गलत सूचना फैलाने के लिए इस्तेमाल न किए जाएं। US AI Safety Institute इन मॉडल्स का गहराई से विश्लेषण करेगा। अभी तक कंपनियां अपने मॉडल्स को गुप्त रखती थीं, लेकिन अब सरकारी निगरानी के तहत उन्हें अपनी कार्यप्रणाली (Methodology) को पारदर्शी बनाना होगा। यह कदम न केवल तकनीकी सुरक्षा को बढ़ावा देगा, बल्कि डेवलपर्स को भी अधिक जिम्मेदार बनाएगा ताकि वे एआई के अनियंत्रित प्रसार को रोक सकें।

तकनीकी विवरण (Technical Insight)

यह प्रक्रिया 'मॉडल इवैल्यूएशन' (Model Evaluation) पर आधारित है। इसमें सरकार के विशेषज्ञ यह देखेंगे कि एआई मॉडल का 'लॉजिक' (Logic) किस तरह काम करता है। इसमें 'रेड टीजिंग' (Red Teaming) का उपयोग किया जाएगा, जहाँ एआई को जानबूझकर गलत इनपुट देकर उसकी प्रतिक्रिया को परखा जाएगा। इससे यह पता चलेगा कि क्या मॉडल खतरनाक निर्देशों का पालन करता है या उन्हें अस्वीकार करता है।

भारत और यूजर्स पर असर (Impact on India)

भारत के लिए यह एक बड़ी सीख है। चूंकि भारत में भी एआई का उपयोग तेजी से बढ़ रहा है, इसलिए वैश्विक स्तर पर सुरक्षा के ये मानक भविष्य में भारतीय नीति निर्माताओं के लिए एक गाइडलाइन का काम करेंगे। भारतीय यूजर्स के लिए इसका सकारात्मक असर होगा, क्योंकि जब वैश्विक कंपनियों के एआई मॉडल्स सुरक्षित होंगे, तो उनका उपयोग भारत में करने पर डेटा सुरक्षा और कंटेंट की विश्वसनीयता का खतरा कम हो जाएगा।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

जी हाँ, फिलहाल यह समझौता US सरकार के साथ हुआ है, लेकिन इसका वैश्विक प्रभाव पड़ना तय है।

AI मॉडल्स के रिलीज होने से पहले सुरक्षा खामियों (Security Vulnerabilities) का पता लगाने के लिए यह आवश्यक है।

कंपनियों ने स्पष्ट किया है कि सुरक्षा जांच के दौरान डेटा की गोपनीयता और सुरक्षा को प्राथमिकता दी जाएगी।