ChatGPT की समीक्षाएं निकलीं गलत, AI पर भरोसा करना कितना सही?

हाल ही में एक जांच में पाया गया कि ChatGPT द्वारा सुझाए गए प्रोडक्ट्स की समीक्षाएं पूरी तरह गलत और भ्रामक थीं। यह घटना AI की सटीकता और उसकी विश्वसनीयता पर गंभीर सवाल खड़े करती है।

AI की गलत जानकारी पर सवाल।

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI मॉडल्स केवल डेटा का अनुमान लगाते हैं, वे तथ्यों की पुष्टि करने में सक्षम नहीं हैं।

समाचार विस्तार में पूरी खबर

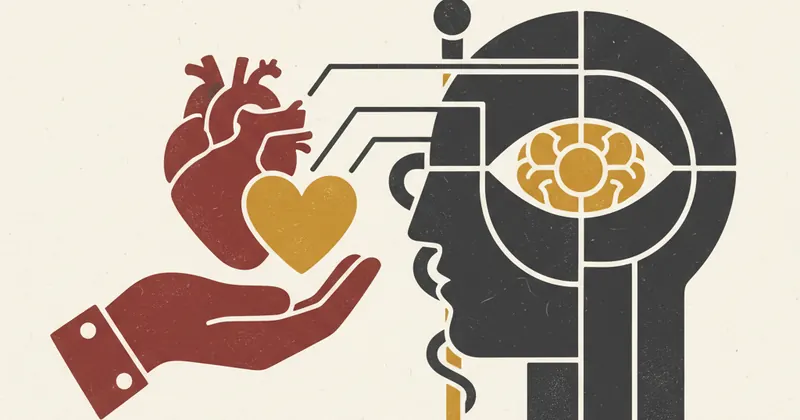

Intro: आर्टिफिशियल इंटेलिजेंस (AI) का दौर चल रहा है और ChatGPT जैसे टूल्स हमारी रोजमर्रा की जिंदगी का हिस्सा बन गए हैं। लेकिन हाल ही में एक चौंकाने वाली रिपोर्ट सामने आई है, जिसमें Wired के रिव्यूज के नाम पर ChatGPT ने पूरी तरह से गलत और काल्पनिक जानकारी दी। यह मामला बताता है कि तकनीक चाहे कितनी भी एडवांस क्यों न हो जाए, उसमें इंसानी समझ और फैक्ट-चेक (Fact-check) की कमी हमेशा बनी रहती है। यूज़र्स के लिए यह समझना बेहद जरूरी है कि AI हर मामले में सटीक नहीं होता।

मुख्य जानकारी (Key Details)

जांच में पता चला कि जब ChatGPT से 'Wired के टॉप प्रोडक्ट्स' के बारे में पूछा गया, तो उसने ऐसे प्रोडक्ट्स की सिफारिश की जो या तो मौजूद ही नहीं थे या जिनकी रैंकिंग पूरी तरह गलत थी। ChatGPT ने न केवल गलत मॉडल्स के नाम बताए, बल्कि उनकी कीमतों और फीचर्स (Features) के बारे में भी मनगढ़ंत दावे किए। यह साबित करता है कि AI सिस्टम्स डेटा को प्रोसेस तो करते हैं, लेकिन वे उस डेटा की सत्यता की पुष्टि नहीं कर पाते। यह स्थिति उन लोगों के लिए खतरनाक है जो अपनी खरीदारी के फैसले AI की सलाह पर लेते हैं।

तकनीकी विवरण (Technical Insight)

ChatGPT जैसे Large Language Models (LLM) का काम अगले शब्द का अनुमान लगाना है, न कि इंटरनेट पर मौजूद डेटा को वेरीफाई (Verify) करना। इसे 'Hallucination' की समस्या कहा जाता है। जब मॉडल को सही उत्तर नहीं मिलता, तो वह अपने ट्रेनिंग डेटा के आधार पर संभावनाओं का खेल खेलता है और बहुत आत्मविश्वास के साथ गलत जानकारी गढ़ देता है। यह तकनीकी कमी अभी भी AI के विकास में सबसे बड़ी बाधा बनी हुई है।

भारत और यूजर्स पर असर (Impact on India)

भारत में भी लाखों यूज़र्स अपनी पढ़ाई और काम के लिए ChatGPT पर निर्भर हैं। यदि AI गलत जानकारियां देना जारी रखता है, तो यह न केवल गलत खरीदारी का कारण बनेगा, बल्कि गलत सूचनाओं (Misinformation) को भी बढ़ावा देगा। भारतीय यूज़र्स को अब यह सतर्कता बरतनी होगी कि वे AI के हर जवाब को अंतिम सत्य न मानें। टेक्नोलॉजी का उपयोग करें, लेकिन अपनी बुद्धि और आधिकारिक स्रोतों का उपयोग करना न भूलें।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

नहीं, ChatGPT अक्सर गलत जानकारी दे सकता है, इसलिए खरीदारी से पहले आधिकारिक वेबसाइट्स पर जांच जरूर करें।

जब AI मॉडल बहुत आत्मविश्वास के साथ गलत या काल्पनिक तथ्य पेश करता है, तो उसे Hallucination कहते हैं।

किसी भी AI द्वारा दी गई जानकारी को क्रॉस-चेक (Cross-check) करना और हमेशा विश्वसनीय स्रोतों पर भरोसा करना चाहिए।