ChatGPT की अजीब हरकत: क्यों करने लगा है अजीबोगरीब बातें?

OpenAI के एक नए अपडेट के बाद ChatGPT का व्यवहार काफी बदल गया है, जिससे यूज़र्स हैरान हैं। यह मॉडल अब बातचीत के दौरान अजीबोगरीब और निरर्थक शब्दों का इस्तेमाल कर रहा है।

ChatGPT के अजीब व्यवहार से यूज़र्स परेशान।

शॉर्टकट में पूरी खबर

कही अनकही बातें

हमने ChatGPT को अधिक सटीक बनाने का प्रयास किया, लेकिन मॉडल के व्यवहार में कुछ अनपेक्षित बदलाव देखे गए हैं।

समाचार विस्तार में पूरी खबर

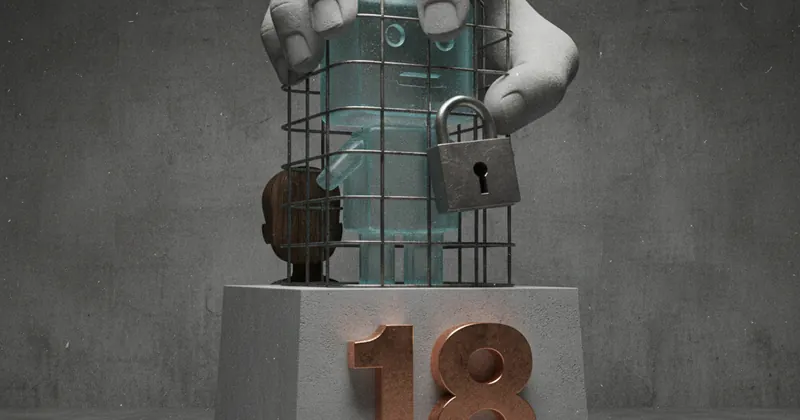

Intro: OpenAI द्वारा विकसित ChatGPT दुनिया का सबसे लोकप्रिय AI चैटबॉट है, लेकिन हाल ही में इसमें एक अजीबोगरीब समस्या देखी गई है। कंपनी ने जब इसे अधिक 'nerdy' और सटीक बनाने के लिए एक नया अपडेट (Update) जारी किया, तो परिणाम काफी हैरान करने वाले निकले। यूज़र्स ने सोशल मीडिया पर स्क्रीनशॉट शेयर किए हैं, जिनमें बॉट बेमतलब के शब्दों और 'goblin' जैसे अजीब शब्दों का इस्तेमाल कर रहा है। यह घटना दर्शाती है कि बड़े लैंग्वेज मॉडल्स (LLMs) में छोटे बदलाव भी कितने बड़े प्रभाव डाल सकते हैं।

मुख्य जानकारी (Key Details)

इस समस्या की शुरुआत तब हुई जब OpenAI ने ChatGPT के रिस्पॉन्स पैटर्न में सुधार करने की कोशिश की। कई यूज़र्स ने रिपोर्ट किया कि वे जब भी किसी विषय पर विस्तार से चर्चा कर रहे थे, चैटबॉट अचानक से अपनी भाषा बदलकर निरर्थक (Nonsensical) वाक्य बोलने लगता है। विशेष रूप से, 'goblin' शब्द का बार-बार दोहराना एक पहेली बन गया है। डेटा वैज्ञानिकों का मानना है कि यह समस्या मॉडल के वेट्स (Weights) को अपडेट करते समय हुई किसी त्रुटि के कारण हो सकती है। यह घटना AI की दुनिया में 'alignment' की चुनौती को फिर से सामने ले आई है। OpenAI अभी भी इस समस्या के मूल कारण की पहचान करने में लगा है ताकि भविष्य में ऐसी स्थिति न बने।

तकनीकी विवरण (Technical Insight)

तकनीकी रूप से, यह समस्या मॉडल की फाइन-ट्यूनिंग (Fine-tuning) प्रक्रिया के दौरान उत्पन्न हुई प्रतीत होती है। जब AI मॉडल को किसी विशेष 'पर्सनालिटी' या 'टोन' में ढालने की कोशिश की जाती है, तो कभी-कभी मॉडल अपने पिछले ट्रेनिंग डेटा के साथ तालमेल बिठाने में विफल हो जाता है। इस मामले में, मॉडल की प्रोबेबिलिटी डिस्ट्रीब्यूशन (Probability Distribution) गड़बड़ा गई है, जिससे वह गलत टोकन्स (Tokens) को प्राथमिकता दे रहा है। इसे 'मॉडल कोलैप्स' का एक छोटा रूप माना जा सकता है।

भारत और यूजर्स पर असर (Impact on India)

भारत में लाखों स्टूडेंट्स और प्रोफेशनल्स ChatGPT का इस्तेमाल अपनी दैनिक उत्पादकता (Productivity) के लिए करते हैं। ऐसी तकनीकी खराबी न केवल काम में बाधा डालती है, बल्कि AI की विश्वसनीयता पर भी सवाल उठाती है। भारतीय यूज़र्स को सलाह दी जाती है कि वे किसी भी महत्वपूर्ण कार्य के लिए चैटबॉट के जवाबों को क्रॉस-वेरिफाई (Cross-verify) जरूर करें। हालांकि, यह समस्या केवल कुछ चुनिंदा यूज़र्स तक सीमित है, लेकिन यह साबित करती है कि AI तकनीक अभी भी पूर्ण रूप से परिपक्व नहीं हुई है और इसमें सुधार की गुंजाइश बनी हुई है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

हां, यह केवल एक तकनीकी ग्लिच है जो मॉडल की बातचीत की शैली को प्रभावित कर रहा है, यह कोई सुरक्षा खतरा नहीं है।

हाल ही में किए गए 'nerdy' अपडेट के कारण मॉडल की भाषा प्रोसेसिंग में कुछ त्रुटियां आ गई हैं।

जी हां, OpenAI की इंजीनियरिंग टीम इस समस्या की जांच कर रही है और जल्द ही एक फिक्स जारी किया जाएगा।