AI स्टार्टअप पर लगा आर्ट चोरी का आरोप, 'This is Fine' क्रिएटर हुए नाराज़

मशहूर 'This is Fine' मीम के क्रिएटर KC Green ने एक AI स्टार्टअप पर बिना अनुमति उनकी कला का उपयोग करने का आरोप लगाया है। यह विवाद जनरेटिव AI मॉडल्स के ट्रेनिंग डेटा और कॉपीराइट सुरक्षा पर गंभीर सवाल खड़े करता है।

AI और कॉपीराइट पर छिड़ा विवाद

शॉर्टकट में पूरी खबर

कही अनकही बातें

मेरे काम को बिना मेरी सहमति के AI को सिखाने के लिए इस्तेमाल करना पूरी तरह से गलत और अनैतिक है।

समाचार विस्तार में पूरी खबर

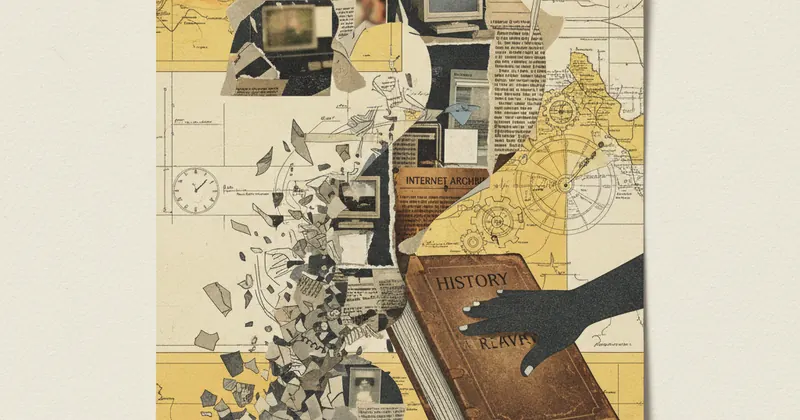

Intro: आर्टिफीसियल इंटेलिजेंस (AI) की दुनिया में इन दिनों विवादों का दौर चल रहा है। हाल ही में मशहूर 'This is Fine' मीम के क्रिएटर KC Green ने एक AI स्टार्टअप के खिलाफ आवाज उठाई है। उनका आरोप है कि स्टार्टअप ने उनके लोकप्रिय मीम का उपयोग बिना उनकी अनुमति के अपने AI मॉडल को ट्रेन करने के लिए किया है। यह घटना तकनीक और क्रिएटिविटी के बीच के उस नाजुक संतुलन को दर्शाती है, जिसे नजरअंदाज करना अब मुश्किल हो गया है।

मुख्य जानकारी (Key Details)

KC Green ने सोशल मीडिया पर स्पष्ट किया है कि उन्होंने अपनी कला को किसी भी AI कंपनी को इस्तेमाल करने की अनुमति नहीं दी थी। यह मामला तब सामने आया जब AI जनरेटेड कंटेंट में उनके काम की नकल देखी गई। स्टार्टअप्स अक्सर इंटरनेट से डेटा स्क्रैपिंग (Data Scraping) के जरिए अपने मॉडल्स को तैयार करते हैं, जिसमें कलाकारों की मेहनत का बिना श्रेय या भुगतान के इस्तेमाल किया जाता है। इस घटना ने तकनीक जगत में नैतिक दुविधा (Ethical Dilemma) पैदा कर दी है। अब क्रिएटर्स मांग कर रहे हैं कि AI कंपनियां डेटा सोर्स के प्रति पारदर्शी (Transparent) बनें और आर्टिस्ट्स को उचित रॉयल्टी या सहमति का विकल्प प्रदान करें। यह मुद्दा न केवल व्यक्तिगत है, बल्कि पूरी रचनात्मक इंडस्ट्री के अस्तित्व से जुड़ा है।

तकनीकी विवरण (Technical Insight)

AI मॉडल मुख्य रूप से लार्ज स्केल डेटासेट (Large Scale Dataset) पर आधारित होते हैं। जब कोई स्टार्टअप अपना मॉडल ट्रेन करता है, तो वह इंटरनेट पर उपलब्ध लाखों इमेजेस को प्रोसेस करता है। इसमें 'ऑप्ट-आउट' (Opt-out) का कोई ठोस सिस्टम न होने के कारण कलाकारों का काम अनजाने में ट्रेनिंग डेटा का हिस्सा बन जाता है। इस प्रक्रिया में पैटर्न रिकग्निशन (Pattern Recognition) का इस्तेमाल होता है, जिससे AI वैसा ही स्टाइल या इमेज दोबारा बना सकता है, जो मूल कलाकार की पहचान होती है।

भारत और यूजर्स पर असर (Impact on India)

भारत में भी तेजी से AI स्टार्टअप्स उभर रहे हैं। यदि अंतरराष्ट्रीय स्तर पर कॉपीराइट कानून सख्त होते हैं, तो भारतीय कंपनियों को भी अपने ट्रेनिंग डेटा सोर्सिंग (Data Sourcing) के नियमों में बदलाव करना होगा। भारतीय आर्टिस्ट्स और कंटेंट क्रिएटर्स के लिए यह समय अपने डिजिटल अधिकारों के प्रति जागरूक होने का है। भविष्य में भारत में भी 'AI-जनरेटेड कंटेंट' के लिए स्पष्ट दिशा-निर्देश (Guidelines) लागू किए जा सकते हैं, जिससे क्रिएटिव इंडस्ट्री को सुरक्षा मिलेगी।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

वर्तमान में यह एक कानूनी ग्रे-एरिया है, लेकिन ज्यादातर क्रिएटर्स इसे कॉपीराइट का उल्लंघन मानते हैं।

AI मॉडल को सिखाने के लिए इंटरनेट से ली गई करोड़ों इमेजेस और टेक्स्ट का डेटाबेस।

हां, यह मामला भविष्य में डिजिटल आर्ट और कॉपीराइट कानूनों के लिए एक ग्लोबल बेंचमार्क तय कर सकता है।