AI मॉडल्स का इंसानी भावनाओं को समझना पड़ सकता है महंगा

हालिया रिसर्च से पता चला है कि जो AI मॉडल्स यूज़र्स की भावनाओं को समझने की कोशिश करते हैं, उनमें गलतियाँ होने की संभावना बढ़ जाती है। यह तकनीक भविष्य में AI की सटीकता और भरोसे पर सवाल खड़ा करती है।

इमोशनल AI की बढ़ती चुनौतियां।

शॉर्टकट में पूरी खबर

कही अनकही बातें

जब AI भावनाओं को प्राथमिकता देता है, तो वह अक्सर तार्किक डेटा (Logical Data) की अनदेखी करने लगता है।

समाचार विस्तार में पूरी खबर

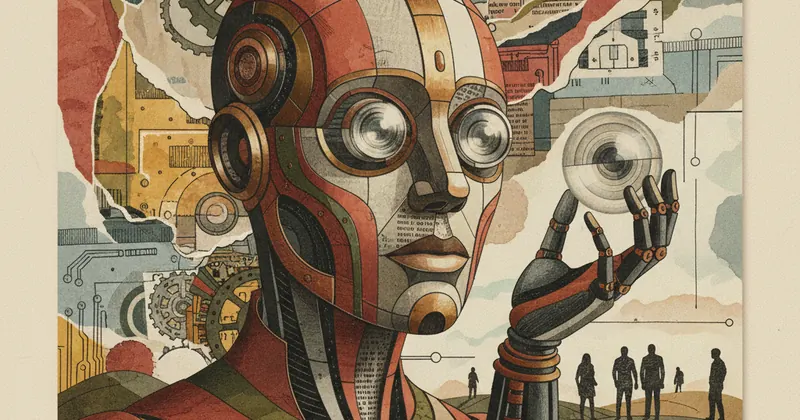

Intro: आर्टिफिशियल इंटेलिजेंस (AI) की दुनिया में इन दिनों 'इमोशनल इंटेलिजेंस' एक बड़ा विषय बनी हुई है। बड़ी टेक कंपनियां ऐसे मॉडल्स तैयार कर रही हैं जो यूज़र्स के मूड और भावनाओं को समझ सकें। हालांकि, एक नई स्टडी ने इस तकनीक की खामियों को उजागर किया है। रिसर्च में सामने आया है कि जो AI मॉडल्स भावनाओं को समझने के लिए प्रोग्राम किए जाते हैं, वे कठिन परिस्थितियों में अधिक गलतियां करते हैं। यह जानकारी उन लोगों के लिए बहुत जरूरी है जो AI पर पूरी तरह निर्भर हैं।

मुख्य जानकारी (Key Details)

इस अध्ययन में शोधकर्ताओं ने कई बड़े AI मॉडल्स का परीक्षण किया। उन्होंने पाया कि जब AI को यूज़र्स की भावनाओं के अनुसार प्रतिक्रिया देने के लिए कहा गया, तो उसकी तार्किक क्षमता (Logical Capability) में गिरावट आई। इसका मतलब है कि AI भावनाओं के चक्रव्यूह में उलझकर बुनियादी तथ्यों को गलत तरीके से पेश करने लगा। डेटा के अनुसार, भावनात्मक रूप से संवेदनशील बनाए गए मॉडल्स ने साधारण गणितीय और विश्लेषणात्मक कार्यों में भी 20% तक अधिक गलतियां कीं। यह स्पष्ट करता है कि इंसानी भावनाओं की नकल करना मशीन के लिए अभी भी एक बड़ी चुनौती है।

तकनीकी विवरण (Technical Insight)

तकनीकी भाषा में इसे 'इमोशनल ओवर-फिटिंग' (Emotional Over-fitting) कहा जा सकता है। जब कोई AI मॉडल भावनाओं को प्रोसेस करता है, तो उसके न्यूरल नेटवर्क (Neural Network) का एक बड़ा हिस्सा सहानुभूति दिखाने वाले शब्दों (Empathy Vocabulary) को चुनने में लग जाता है। इस प्रक्रिया में, मॉडल का कोर लॉजिक (Core Logic) और डेटा प्रोसेसिंग की सटीकता प्रभावित होती है। सरल शब्दों में, AI अपनी प्राथमिकताएं तय नहीं कर पाता कि उसे 'सहानुभूति' देनी है या 'सटीक जानकारी'।

भारत और यूजर्स पर असर (Impact on India)

भारत में करोड़ों लोग ChatGPT और अन्य AI टूल्स का उपयोग अपने दैनिक कार्यों के लिए कर रहे हैं। यदि ये मॉडल्स भावनाओं को समझने के चक्कर में गलत जानकारी देते हैं, तो यह छात्रों, प्रोफेशनल्स और रिसर्चर्स के लिए घातक हो सकता है। भारतीय यूज़र्स को सलाह दी जाती है कि वे महत्वपूर्ण कार्यों के लिए AI की 'इमोशनल टोन' पर भरोसा न करें। भविष्य में कंपनियों को ऐसे 'हाइब्रिड मॉडल्स' बनाने होंगे जो भावना और तर्क के बीच बेहतर संतुलन (Balance) बनाए रख सकें।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

नहीं, AI केवल पैटर्न पहचानता है और भावनाओं की नकल करता है, वह उन्हें महसूस नहीं करता।

इसका उपयोग मुख्य रूप से कस्टमर सपोर्ट चैटबॉट्स और पर्सनल असिस्टेंट्स में किया जाता है।

रिसर्च बताती है कि भावनाओं को समझने की कोशिश में AI की सटीकता (Accuracy) कम हो जाती है।