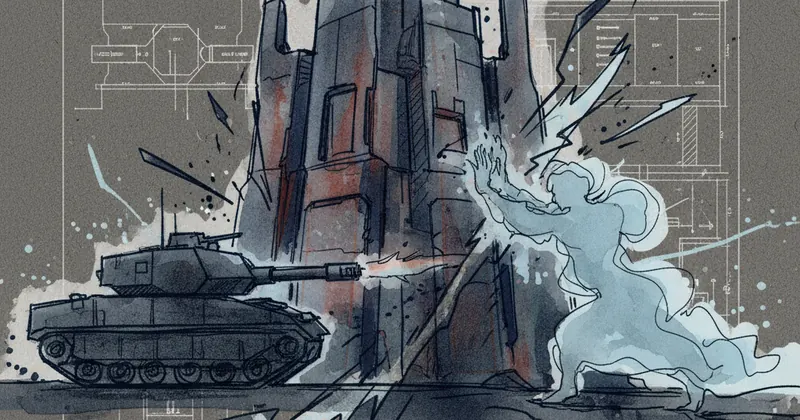

अमेरिकी सेना के लिए Anthropic के AI मॉडल्स तक पहुंच की मांग

अमेरिकी राजनेता पीट हेगसेथ (Pete Hegseth) ने Anthropic के AI मॉडल्स को सैन्य उपयोग (Military Use) के लिए बिना किसी प्रतिबंध के उपलब्ध कराने की मांग की है। यह कदम AI सुरक्षा और नैतिकता (AI Safety and Ethics) पर एक नई बहस छेड़ सकता है।

Anthropic के AI मॉडल्स पर सैन्य पहुंच की बहस

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI टेक्नोलॉजी को देश की सुरक्षा के लिए बिना किसी देरी के उपलब्ध होना चाहिए।

समाचार विस्तार में पूरी खबर

Intro: हाल ही में, अमेरिकी राजनीति और रक्षा क्षेत्र में एक महत्वपूर्ण चर्चा शुरू हुई है। अमेरिकी राजनेता पीट हेगसेथ (Pete Hegseth) ने AI कंपनी Anthropic से आग्रह किया है कि वह अपने उन्नत AI मॉडल्स तक अमेरिकी सेना (US Military) को बिना किसी रोक-टोक के पहुंच प्रदान करे। यह मांग विशेष रूप से तब महत्वपूर्ण है जब वैश्विक स्तर पर AI का उपयोग रक्षा क्षेत्र में तेजी से बढ़ रहा है। हेगसेथ का मानना है कि देश की सुरक्षा के लिए इन शक्तिशाली AI टूल्स का तत्काल उपयोग आवश्यक है, और सुरक्षा संबंधी चिंताओं के कारण इन तक पहुंच को सीमित नहीं किया जाना चाहिए।

मुख्य जानकारी (Key Details)

पीट हेगसेथ ने स्पष्ट रूप से कहा है कि Anthropic के AI मॉडल्स, जो अपनी उन्नत क्षमताओं और सुरक्षा प्रोटोकॉल के लिए जाने जाते हैं, को सैन्य अभियानों (Military Operations) में एकीकृत किया जाना चाहिए। Anthropic ने हमेशा AI सुरक्षा को प्राथमिकता दी है और अपने मॉडल्स को 'गार्डरेल्स' (Guardrails) के साथ विकसित किया है ताकि हानिकारक उपयोग को रोका जा सके। हालांकि, हेगसेथ जैसे अधिकारी तर्क दे रहे हैं कि राष्ट्रीय सुरक्षा के मामलों में इन गार्डरेल्स को हटा देना चाहिए या कम कर देना चाहिए ताकि सेना को पूरी क्षमता का उपयोग करने की अनुमति मिल सके। यह मांग AI कंपनियों पर दबाव बढ़ा रही है कि वे अपनी सुरक्षा नीतियों और सैन्य सहयोग के बीच संतुलन कैसे बनाएं। यह देखना दिलचस्प होगा कि Anthropic इस राजनीतिक दबाव पर क्या प्रतिक्रिया देता है।

तकनीकी विवरण (Technical Insight)

Anthropic के AI मॉडल्स, जैसे Claude 3, बड़े भाषा मॉडल (Large Language Models - LLMs) पर आधारित हैं। ये मॉडल जटिल पैटर्न को समझने और टेक्स्ट जनरेट करने में सक्षम हैं। सैन्य संदर्भ में, इनका उपयोग खुफिया रिपोर्टों का विश्लेषण करने, निर्णय समर्थन प्रणाली (Decision Support Systems) बनाने और संचार को स्वचालित करने के लिए किया जा सकता है। आमतौर पर, Anthropic इन मॉडल्स में 'Constitutional AI' जैसे फ्रेमवर्क का उपयोग करता है, जो उन्हें हानिकारक या अनैतिक आउटपुट देने से रोकता है। हेगसेथ की मांग इस तकनीकी ढांचे को चुनौती देती है, क्योंकि सैन्य उपयोग के लिए ऐसे प्रतिबंधों को हटाया जा सकता है।

भारत और यूजर्स पर असर (Impact on India)

हालांकि यह सीधे तौर पर भारतीय यूजर्स को प्रभावित नहीं करता है, लेकिन इस तरह के निर्णय वैश्विक AI सुरक्षा मानकों (Global AI Safety Standards) पर असर डालते हैं। यदि अमेरिका में रक्षा उद्देश्यों के लिए AI सुरक्षा नियमों में ढील दी जाती है, तो अन्य देशों में भी इसी तरह की मांगें उठ सकती हैं। भारत भी अपने रक्षा क्षेत्र में AI को अपनाने पर विचार कर रहा है, इसलिए यह घटनाक्रम भारतीय AI नीति निर्माताओं के लिए एक महत्वपूर्ण केस स्टडी बन सकता है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

पीट हेगसेथ एक अमेरिकी टेलीविजन होस्ट और पूर्व आर्मी नेशनल गार्ड अधिकारी हैं, जो अक्सर रक्षा और सुरक्षा मुद्दों पर अपनी राय रखते हैं।

Anthropic एक अग्रणी AI रिसर्च और डेवलपमेंट कंपनी है जो सुरक्षित और लाभकारी AI सिस्टम बनाने पर केंद्रित है।

Anthropic के मॉडल्स, जैसे कि Claude, सुरक्षा (Safety) और नैतिक दिशानिर्देशों (Ethical Guidelines) पर विशेष ध्यान देते हैं।

AI मॉडल्स का सैन्य उपयोग रणनीतिक लाभ (Strategic Advantage) प्रदान कर सकता है, जैसे कि डेटा विश्लेषण और खुफिया जानकारी जुटाना।