ट्रम्प के नए AI फ्रेमवर्क में पेरेंट्स पर बढ़ी जिम्मेदारी

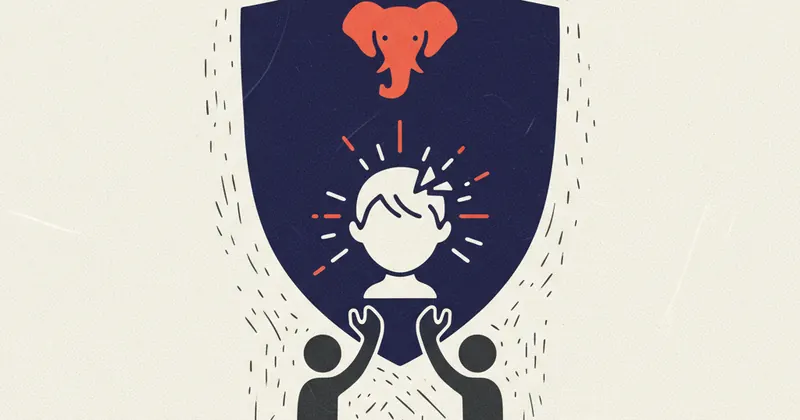

पूर्व राष्ट्रपति डोनाल्ड ट्रम्प के प्रशासन ने आर्टिफिशियल इंटेलिजेंस (AI) के लिए एक नया ढांचा (Framework) प्रस्तावित किया है, जो AI मॉडलों में चाइल्ड सेफ्टी के नियमों को लेकर राज्यों के हस्तक्षेप को सीमित करता है। यह फ्रेमवर्क AI कंपनियों पर जिम्मेदारी कम करके माता-पिता पर अधिक निर्भरता डालता है।

ट्रम्प के AI फ्रेमवर्क से बढ़ी पेरेंट्स की जिम्मेदारी

शॉर्टकट में पूरी खबर

कही अनकही बातें

यह फ्रेमवर्क AI इनोवेशन को प्रोत्साहित करने के लिए डिज़ाइन किया गया है, लेकिन चाइल्ड सेफ्टी के मानकों पर चिंताएं बनी हुई हैं।

समाचार विस्तार में पूरी खबर

Intro: हाल ही में, पूर्व राष्ट्रपति डोनाल्ड ट्रम्प के प्रशासन ने आर्टिफिशियल इंटेलिजेंस (AI) के लिए एक नया फ्रेमवर्क प्रस्तावित किया है, जिसने टेक जगत में हलचल मचा दी है। यह फ्रेमवर्क AI मॉडल्स में चाइल्ड सेफ्टी (Child Safety) से जुड़े नियमों पर राज्यों के हस्तक्षेप को सीमित करने पर केंद्रित है। इसका मुख्य उद्देश्य AI कंपनियों के लिए रेगुलेटरी माहौल को सरल बनाना है, लेकिन इसके परिणामस्वरूप चाइल्ड सेफ्टी की जिम्मेदारी काफी हद तक माता-पिता पर स्थानांतरित हो गई है। यह कदम AI के विकास को तेजी देने के लिए उठाया गया है, लेकिन यह नैतिक और सुरक्षा संबंधी गंभीर सवाल खड़े करता है।

मुख्य जानकारी (Key Details)

प्रस्तावित फ्रेमवर्क के अनुसार, AI सिस्टम्स के कंटेंट को रेगुलेट करने की जिम्मेदारी मुख्य रूप से पेरेंट्स की होगी, न कि राज्यों या केंद्रीय एजेंसियों की। यह फ्रेमवर्क AI डेवलपमेंट को गति देने के लिए एक उदार दृष्टिकोण अपनाता है, जिससे कंपनियों को कम कानूनी बाधाओं का सामना करना पड़े। सूत्रों के अनुसार, यह कदम उन राज्यों के कानूनों को ओवरराइड कर सकता है जो AI प्लेटफॉर्म्स पर विशिष्ट चाइल्ड सेफ्टी फीचर्स लागू करना चाहते हैं। AI मॉडल्स में आपत्तिजनक सामग्री (Inappropriate Content) को फ़िल्टर करने की जिम्मेदारी अब डेवलपर्स के बजाय अंतिम यूज़र या उनके माता-पिता पर डाली जा रही है। यह एक बड़ा बदलाव है क्योंकि AI तकनीकें पहले से कहीं अधिक जटिल और सर्वव्यापी होती जा रही हैं।

तकनीकी विवरण (Technical Insight)

इस फ्रेमवर्क का तकनीकी निहितार्थ यह है कि AI कंपनियों को अपने मॉडल्स में जटिल 'सेफ्टी फिल्टर्स' (Safety Filters) या कंटेंट मॉडरेशन (Content Moderation) सिस्टम्स को लागू करने की आवश्यकता कम होगी। पहले, कई रेगुलेटरी प्रस्तावों में AI प्रदाताओं को यह सुनिश्चित करने के लिए बाध्य किया जाता था कि उनके टूल्स बच्चों के लिए सुरक्षित हों। लेकिन इस नए फ्रेमवर्क के तहत, कंपनियां केवल सामान्य गाइडलाइन्स का पालन करेंगी, जबकि विशिष्ट चाइल्ड सेफ्टी कंट्रोल पेरेंट्स द्वारा मैनेज किए जाएंगे। यह 'Parental Controls' पर निर्भरता को बढ़ाता है, जो कई बार तकनीकी रूप से मजबूत नहीं होते हैं।

भारत और यूजर्स पर असर (Impact on India)

हालांकि यह प्रस्ताव मुख्य रूप से अमेरिकी संदर्भ में है, लेकिन वैश्विक तकनीक पर इसका असर भारत पर भी पड़ेगा। भारत में भी AI रेगुलेशन पर बहस चल रही है। यदि यह दृष्टिकोण अपनाया जाता है, तो यह भारत जैसी बड़ी टेक मार्केट में भी AI कंपनियों को रेगुलेशन से बचने का एक रास्ता दे सकता है। भारतीय यूज़र्स, खासकर माता-पिता, को अपने बच्चों के लिए AI एक्सेस को लेकर अधिक सतर्क रहने की आवश्यकता होगी, क्योंकि प्लेटफॉर्म्स द्वारा प्रदान की जाने वाली सुरक्षा कम हो सकती है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

यह एक प्रस्तावित ढांचा है जो AI मॉडलों में चाइल्ड सेफ्टी नियमों को राज्यों द्वारा नियंत्रित करने के बजाय पेरेंट्स की जिम्मेदारी पर अधिक केंद्रित करता है।

यह AI कंपनियों को राज्य-स्तरीय रेगुलेशन की जटिलताओं से बचाने का प्रयास करता है, जिससे उन्हें अपने मॉडल्स विकसित करने में आसानी हो सकती है।

कुछ विशेषज्ञों का मानना है कि पेरेंट्स पर अधिक निर्भरता बच्चों की सुरक्षा के लिए जोखिम पैदा कर सकती है, खासकर जब AI टूल्स अधिक शक्तिशाली हो रहे हैं।