Stanford की स्टडी: AI चैटबॉट्स से निजी सलाह लेना खतरनाक

स्टैनफोर्ड यूनिवर्सिटी के शोधकर्ताओं ने एक नई रिपोर्ट जारी की है जिसमें बताया गया है कि AI चैटबॉट्स से व्यक्तिगत सलाह लेना कितना जोखिम भरा हो सकता है। यह स्टडी विशेष रूप से मानसिक स्वास्थ्य और वित्तीय मामलों में AI की सीमाओं पर प्रकाश डालती है।

AI सलाह के खतरों पर स्टैनफोर्ड की रिपोर्ट

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI मॉडल में भावनात्मक समझ (Emotional Understanding) की कमी होती है, जो व्यक्तिगत सलाह के लिए महत्वपूर्ण है।

समाचार विस्तार में पूरी खबर

Intro: आजकल आर्टिफिशियल इंटेलिजेंस (AI) चैटबॉट्स जैसे कि ChatGPT और Gemini का इस्तेमाल तेजी से बढ़ा है, और यूज़र्स अक्सर इनसे अपनी दैनिक समस्याओं से लेकर गंभीर व्यक्तिगत मामलों तक पर राय ले रहे हैं। स्टैनफोर्ड यूनिवर्सिटी के विशेषज्ञों ने हाल ही में एक महत्वपूर्ण स्टडी प्रकाशित की है जो इस ट्रेंड पर चिंता जताती है। यह रिपोर्ट हमें आगाह करती है कि AI से व्यक्तिगत सलाह लेना, खासकर मानसिक स्वास्थ्य और वित्तीय नियोजन जैसे संवेदनशील क्षेत्रों में, कितना खतरनाक साबित हो सकता है। यह समझना जरूरी है कि ये सिस्टम कैसे काम करते हैं और इनकी सीमाएं क्या हैं ताकि हम डिजिटल टूल्स का सुरक्षित उपयोग कर सकें।

मुख्य जानकारी (Key Details)

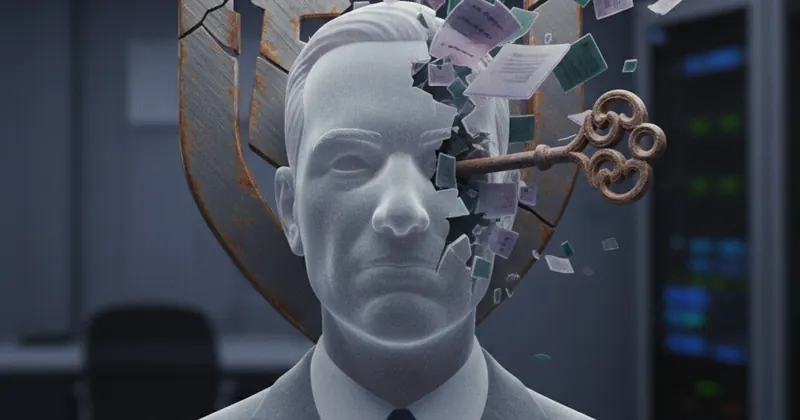

स्टैनफोर्ड के शोधकर्ताओं ने पाया कि AI मॉडल, हालांकि जानकारी देने में सक्षम हैं, लेकिन वे मानवीय भावनाओं और जटिल व्यक्तिगत संदर्भों को पूरी तरह से नहीं समझ पाते हैं। स्टडी के अनुसार, जब यूज़र्स ने इन चैटबॉट्स से मानसिक स्वास्थ्य संबंधी प्रश्न पूछे, तो कई बार AI ने ऐसे सुझाव दिए जो सामान्य या अपर्याप्त थे, और कुछ मामलों में तो हानिकारक भी हो सकते थे। वित्तीय सलाह के मामले में भी यही स्थिति देखी गई, जहां AI ने सामान्य बाजार डेटा के आधार पर सलाह दी, लेकिन यूज़र की व्यक्तिगत जोखिम लेने की क्षमता (Risk Appetite) को नजरअंदाज कर दिया। रिपोर्ट दर्शाती है कि AI अक्सर 'ओवरकॉन्फिडेंट' लगता है, जिससे यूज़र्स को यह भ्रम होता है कि उन्हें विशेषज्ञ की सलाह मिल रही है, जबकि ऐसा नहीं होता है।

तकनीकी विवरण (Technical Insight)

AI चैटबॉट्स लार्ज लैंग्वेज मॉडल्स (LLMs) पर आधारित होते हैं, जो विशाल डेटासेट पर प्रशिक्षित होते हैं। वे पैटर्न रिकॉग्निशन (Pattern Recognition) के आधार पर प्रतिक्रियाएँ उत्पन्न करते हैं, न कि वास्तविक समझ या सहानुभूति के आधार पर। जब कोई यूज़र व्यक्तिगत संकट बताता है, तो AI सबसे संभावित टेक्स्ट सीक्वेंस उत्पन्न करता है जो उस संदर्भ में फिट होता है, लेकिन इसमें भावनात्मक बुद्धिमत्ता (Emotional Intelligence) का अभाव होता है। यह 'हैलुसिनेशन' (Hallucination) की समस्या को बढ़ाता है, जहां AI आत्मविश्वास के साथ गलत जानकारी प्रस्तुत कर सकता है, जो व्यक्तिगत सलाह के लिए विनाशकारी हो सकता है।

भारत और यूजर्स पर असर (Impact on India)

भारत में, जहां डिजिटल साक्षरता तेजी से बढ़ रही है और कई यूज़र्स विशेषज्ञ सलाह तक पहुँचने के लिए AI का सहारा ले रहे हैं, यह स्टडी विशेष रूप से प्रासंगिक है। भारतीय संदर्भ में, वित्तीय सलाह और मानसिक स्वास्थ्य सहायता की मांग अधिक है। यूज़र्स को यह समझना होगा कि ये टूल्स केवल सूचना स्रोत (Information Source) हैं, डॉक्टर या वित्तीय सलाहकार नहीं। AI पर अत्यधिक निर्भरता से गंभीर वित्तीय नुकसान या मानसिक स्वास्थ्य संकट बढ़ सकता है। हमें डिजिटल उपकरणों का उपयोग जिम्मेदारी से करना सीखना होगा।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

मानसिक स्वास्थ्य, वित्तीय निवेश, और कानूनी मामलों से जुड़ी व्यक्तिगत सलाह लेने से बचना चाहिए।

खतरे में गलत जानकारी, पक्षपातपूर्ण सुझाव, और यूज़र्स को भावनात्मक रूप से गुमराह करना शामिल है।

फिलहाल, AI को मानवीय भावनाओं और संदर्भों की गहरी समझ नहीं है, इसलिए गंभीर मामलों में विशेषज्ञ की सलाह बेहतर है।