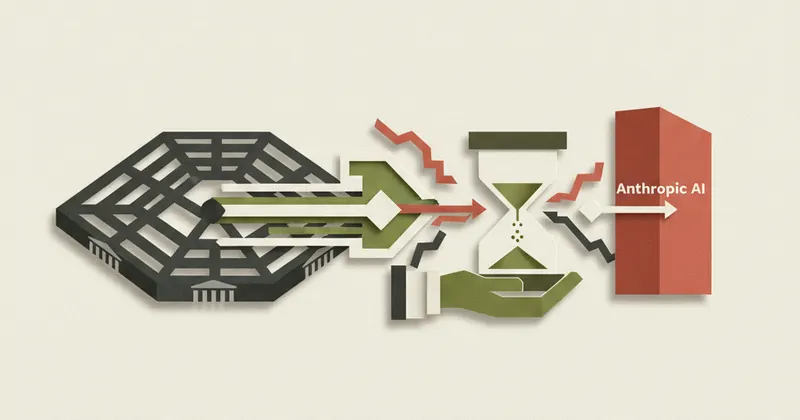

पेंटागन ने Anthropic को Claude AI के उपयोग की दी समय सीमा

अमेरिकी रक्षा विभाग (Pentagon) ने Anthropic को अपने AI मॉडल Claude के उपयोग को लेकर शुक्रवार तक का समय दिया है। यह कदम क्लाउड-आधारित AI सेवाओं के लिए एक महत्वपूर्ण डेवलपमेंट है।

पेंटागन और Anthropic के बीच AI एक्सेस को लेकर चर्चा

शॉर्टकट में पूरी खबर

कही अनकही बातें

यह मामला दिखाता है कि अमेरिकी सरकार अपने महत्वपूर्ण कार्यों के लिए बड़े भाषा मॉडल (LLMs) के उपयोग पर कितनी गंभीरता से विचार कर रही है।

समाचार विस्तार में पूरी खबर

Intro: हाल ही में एक बड़ी खबर सामने आई है जिसमें अमेरिकी रक्षा विभाग, जिसे आमतौर पर पेंटागन (Pentagon) कहा जाता है, ने AI कंपनी Anthropic को उसके शक्तिशाली AI मॉडल Claude के उपयोग के संबंध में एक सख्त समय सीमा दी है। यह डेवलपमेंट दर्शाता है कि सरकारी एजेंसियां किस तरह तेजी से आधुनिक AI टेक्नोलॉजी को अपने सिस्टम में इंटीग्रेट करने की कोशिश कर रही हैं। पेंटागन चाहता है कि Anthropic उसे Claude के उपयोग की पूरी स्वतंत्रता दे, ताकि वे अपने डिफेंस ऑपरेशन्स में इसका इस्तेमाल कर सकें। यह मामला AI गवर्नेंस और राष्ट्रीय सुरक्षा के बीच संतुलन स्थापित करने की वैश्विक चुनौती को उजागर करता है।

मुख्य जानकारी (Key Details)

रिपोर्ट्स के अनुसार, पेंटागन ने Anthropic को यह साफ कर दिया है कि यदि वे क्लाउड-आधारित AI सेवाओं का उपयोग करना चाहते हैं, तो उन्हें Claude मॉडल तक पूर्ण और अनियंत्रित एक्सेस देना होगा। यह एक्सेस खासकर उन क्लाउड-आधारित सेवाओं के लिए आवश्यक है जिनका उपयोग पेंटागन अपने संवेदनशील कार्यों के लिए कर सकता है। Anthropic को शुक्रवार तक इस पर अंतिम निर्णय लेना है। यह स्थिति Anthropic के लिए एक मुश्किल स्थिति पैदा करती है, क्योंकि उन्हें अपने AI मॉडल की सुरक्षा और जिम्मेदारी (Responsibility) को बनाए रखने और साथ ही एक प्रमुख सरकारी क्लाइंट की मांग को पूरा करने के बीच संतुलन बनाना होगा। यह निर्णय सिर्फ Anthropic के लिए ही नहीं, बल्कि पूरे AI उद्योग के लिए महत्वपूर्ण है कि कैसे संवेदनशील सरकारी संस्थाएं कमर्शियल AI मॉडल्स का उपयोग करेंगी।

तकनीकी विवरण (Technical Insight)

Claude एक लार्ज लैंग्वेज मॉडल (LLM) है जो GPT-4 जैसे मॉडल्स को टक्कर देता है। पेंटागन संभवतः Claude की प्राकृतिक भाषा प्रोसेसिंग (NLP) क्षमताओं और जटिल डेटा को समझने की क्षमता का लाभ उठाना चाहता है। पेंटागन की मांग शायद डेटा एक्सेस और मॉडल ट्यूनिंग (Model Tuning) से संबंधित है, ताकि वे विशिष्ट डिफेंस-संबंधित कार्यों के लिए मॉडल को अनुकूलित कर सकें। Anthropic को यह सुनिश्चित करना होगा कि इस एक्सेस से मॉडल की कोर सुरक्षा प्रोटोकॉल (Core Security Protocols) से समझौता न हो, जो उनके AI मॉडल के सुरक्षित और नैतिक विकास का आधार है।

भारत और यूजर्स पर असर (Impact on India)

हालांकि यह निर्णय सीधे तौर पर भारत से संबंधित नहीं है, लेकिन यह वैश्विक AI नीतियों और सरकारी खरीद (Government Procurement) को प्रभावित करेगा। भारत सरकार भी अपनी विभिन्न एजेंसियों में AI को अपनाने की दिशा में काम कर रही है। इस तरह के अंतरराष्ट्रीय घटनाक्रम यह तय करने में मदद करेंगे कि भविष्य में भारतीय सरकारी संस्थाएं विदेशी AI कंपनियों के साथ किस तरह के समझौतों पर विचार कर सकती हैं। यह AI सुरक्षा मानकों को लेकर भी एक बेंचमार्क स्थापित कर सकता है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

Anthropic एक प्रमुख AI रिसर्च और डेवलपमेंट कंपनी है जो Claude नामक शक्तिशाली लार्ज लैंग्वेज मॉडल (LLM) बनाती है। यह OpenAI की एक बड़ी प्रतियोगी है।

पेंटागन संभवतः अपने विभिन्न ऑपरेशन्स, डेटा एनालिसिस और निर्णय लेने की प्रक्रियाओं में AI की क्षमताओं का उपयोग करना चाहता है।

इस डेडलाइन का मतलब है कि Anthropic को यह तय करना होगा कि वह पेंटागन को अपने Claude मॉडल का उपयोग करने की अनुमति देगा या नहीं, खासकर सुरक्षा और डेटा गवर्नेंस के नियमों के तहत।