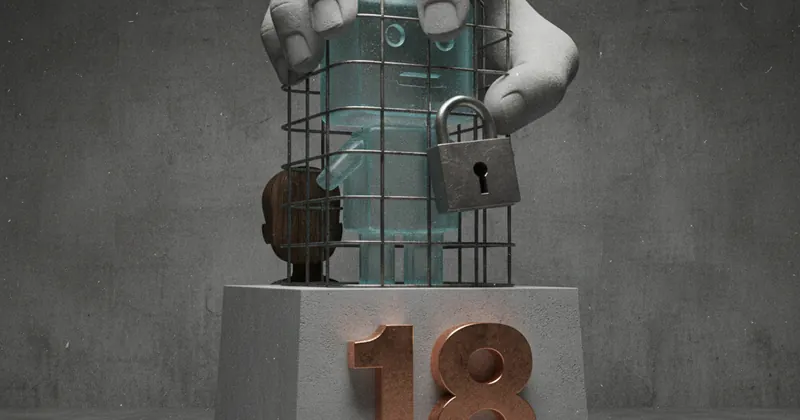

OpenAI ने अपने AI मॉडल 'Cyber' पर लगाई पाबंदियां

OpenAI ने सुरक्षा कारणों का हवाला देते हुए अपने 'Cyber' मॉडल तक यूज़र्स की पहुंच को सीमित कर दिया है। यह कदम कंपनी की जिम्मेदार AI विकास की दिशा में एक बड़ी पहल माना जा रहा है।

OpenAI का लोगो और AI सुरक्षा का चित्रण।

शॉर्टकट में पूरी खबर

कही अनकही बातें

सुरक्षा हमारी प्राथमिकता है और हम यह सुनिश्चित करना चाहते हैं कि हमारे टूल्स का इस्तेमाल केवल सकारात्मक उद्देश्यों के लिए हो।

समाचार विस्तार में पूरी खबर

Intro: आर्टिफिशियल इंटेलिजेंस की दुनिया में OpenAI का नाम सबसे आगे है, लेकिन अब कंपनी अपने ही बनाए 'Cyber' मॉडल को लेकर सतर्क हो गई है। हाल ही में OpenAI ने इस मॉडल तक यूज़र्स की पहुंच को सीमित करने का बड़ा फैसला लिया है। यह निर्णय तब आया है जब AI के दुरुपयोग को लेकर वैश्विक स्तर पर चिंताएं बढ़ रही हैं। 'TechSaral' के पाठकों के लिए यह समझना जरूरी है कि कैसे एक शक्तिशाली टूल को सुरक्षित दायरे में रखना अब कंपनियों की बड़ी चुनौती बन गया है।

मुख्य जानकारी (Key Details)

OpenAI का 'Cyber' मॉडल अपनी उन्नत क्षमताओं के लिए जाना जाता है, लेकिन इसकी यही ताकत अब सुरक्षा विशेषज्ञों के लिए सिरदर्द बन गई है। कंपनी ने यह स्पष्ट किया है कि वे Anthropic जैसी अन्य कंपनियों की तरह ही अब अपने मॉडल्स के साथ 'Safety Filters' को और अधिक सख्त बना रहे हैं। इस बदलाव के तहत, डेवलपर्स को अब 'Cyber' मॉडल का उपयोग करने के लिए कड़े वेरिफिकेशन प्रोसेस से गुजरना होगा। कंपनी का लक्ष्य AI के जरिए होने वाले फिशिंग (Phishing) या मैलवेयर (Malware) निर्माण जैसे खतरों को जड़ से खत्म करना है। यह कदम न केवल डेवलपर्स के लिए है, बल्कि उन सभी प्लेटफॉर्म्स के लिए भी है जो OpenAI की API का उपयोग करते हैं।

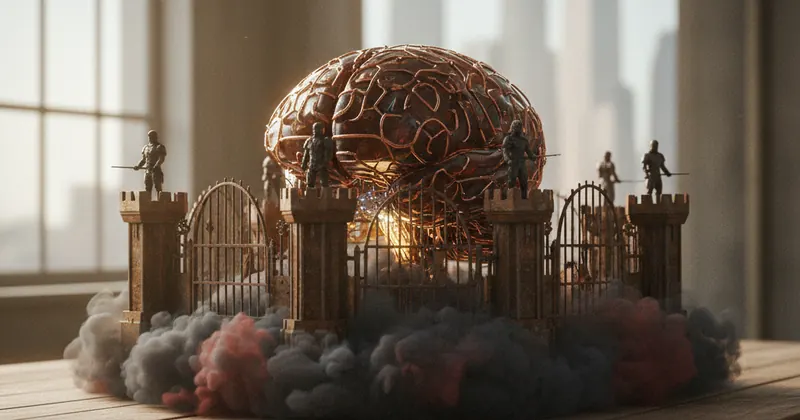

तकनीकी विवरण (Technical Insight)

यह प्रक्रिया मुख्य रूप से 'API Rate Limiting' और 'Automated Content Moderation' के जरिए काम करती है। जब भी कोई यूज़र 'Cyber' मॉडल को प्रॉम्प्ट भेजता है, तो सिस्टम उसे 'Security Layer' के जरिए स्कैन करता है। यदि इनपुट में कोई भी संदिग्ध कोड या साइबर-अटैक से जुड़ा संकेत मिलता है, तो मॉडल उसे प्रोसेस करने से मना कर देता है। यह एक 'Heuristic-based' सुरक्षा तंत्र है जो रियल-टाइम में खतरों को भांप लेता है।

भारत और यूजर्स पर असर (Impact on India)

भारत में तेजी से बढ़ते AI स्टार्टअप्स और डेवलपर्स के लिए यह एक महत्वपूर्ण संकेत है। भारतीय डेवलपर्स जो OpenAI के API पर निर्भर हैं, उन्हें अब अपने 'Use Cases' को अधिक पारदर्शी और सुरक्षित बनाना होगा। हालांकि, यह कदम भारतीय यूज़र्स के डेटा को अधिक सुरक्षित बनाने में भी मदद करेगा। आने वाले समय में, हम देख सकते हैं कि अन्य AI कंपनियां भी 'Responsible AI' के नाम पर इसी तरह के कड़े नियम लागू करेंगी, जिससे भारत का टेक इकोसिस्टम अधिक सुरक्षित और विश्वसनीय बनेगा।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

संभावित सुरक्षा जोखिमों और दुरुपयोग को रोकने के लिए कंपनी ने एक्सेस को सीमित किया है।

ज्यादातर सामान्य यूज़र्स के लिए ChatGPT का अनुभव पहले जैसा ही रहेगा, यह पाबंदी मुख्य रूप से डेवलपर्स और API एक्सेस पर है।

OpenAI ने यह बदलाव तत्काल प्रभाव से अपनी पॉलिसी में शामिल कर लिए हैं।