भारत में AI एजेंट्स के रेगुलेशन पर बड़ी चर्चा

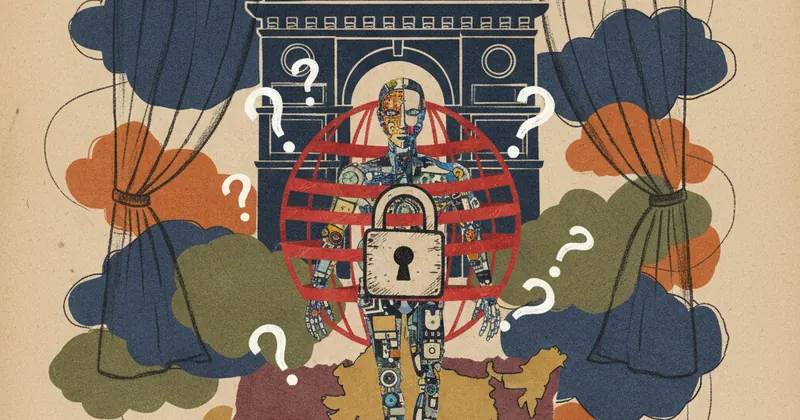

भारत सरकार AI एजेंट्स (AI Agents) के नियमन (Regulation) को लेकर गंभीर है और इस पर बंद दरवाजों के पीछे चर्चाएं हो रही हैं। मुख्य चिंताएं AI सिस्टम्स की जवाबदेही (Accountability) और संभावित जोखिमों (Risks) को लेकर हैं।

भारत सरकार AI एजेंट्स के रेगुलेशन पर विचार कर रही है।

शॉर्टकट में पूरी खबर

कही अनकही बातें

AI एजेंट्स के अनियंत्रित विकास से उत्पन्न होने वाले जोखिमों को कम करना महत्वपूर्ण है।

हमें नवाचार (Innovation) को प्रोत्साहित करते हुए सुरक्षा सुनिश्चित करने वाला संतुलन बनाना होगा।

समाचार विस्तार में पूरी खबर

Intro: आर्टिफिशियल इंटेलिजेंस (AI) के क्षेत्र में तेजी से हो रहे विकास के बीच, भारत सरकार अब AI एजेंट्स के नियमन (Regulation) को लेकर गंभीर हो गई है। हाल ही में हुई बंद दरवाजों की चर्चाओं से यह संकेत मिलता है कि सरकार AI टेक्नोलॉजी से जुड़े जोखिमों को कम करने और एक सुरक्षित फ्रेमवर्क स्थापित करने के लिए सक्रिय कदम उठा रही है। यह कदम भारत में AI के भविष्य और इसके नैतिक उपयोग के लिए महत्वपूर्ण साबित हो सकता है, क्योंकि AI एजेंट्स की क्षमताएं लगातार बढ़ रही हैं।

मुख्य जानकारी (Key Details)

सरकारी स्तर पर हो रही इन चर्चाओं का मुख्य केंद्र AI एजेंट्स की जवाबदेही (Accountability) तय करना है। चर्चाओं में इस बात पर जोर दिया जा रहा है कि यदि कोई AI एजेंट गलती करता है या अनपेक्षित परिणाम देता है, तो उसकी जिम्मेदारी किसकी होगी। यह विशेष रूप से तब महत्वपूर्ण हो जाता है जब AI एजेंट्स जटिल निर्णय लेने में सक्षम हो जाते हैं। अधिकारियों का ध्यान उन AI सिस्टम्स पर है जो बिना मानवीय हस्तक्षेप के कार्य करते हैं। सरकार विभिन्न स्टेकहोल्डर्स, जैसे कि टेक कंपनियों, शिक्षाविदों और नागरिक समाज संगठनों से इनपुट ले रही है ताकि एक संतुलित रेगुलेशन फ्रेमवर्क बनाया जा सके जो नवाचार (Innovation) को बाधित न करे, लेकिन साथ ही सुरक्षा सुनिश्चित करे।

तकनीकी विवरण (Technical Insight)

AI एजेंट्स अक्सर लार्ज लैंग्वेज मॉडल्स (LLMs) पर आधारित होते हैं जो विभिन्न कार्यों को स्वचालित (Automate) करने के लिए डिज़ाइन किए जाते हैं। इनकी मुख्य तकनीकी चुनौती 'अलाइनमेंट' (Alignment) है, यानी यह सुनिश्चित करना कि एजेंटों के लक्ष्य डेवलपर्स के इरादों के अनुरूप हों। रेगुलेशन में शायद 'रेड-टीमिंग' (Red Teaming) और कठोर परीक्षण (Rigorous Testing) जैसे मानकों को शामिल किया जा सकता है ताकि यह सुनिश्चित हो सके कि एजेंट हानिकारक या पक्षपाती (Biased) आउटपुट न दें। सिस्टम की पारदर्शिता (Transparency) और ऑडिटिंग क्षमताएं भी महत्वपूर्ण फोकस क्षेत्र हैं।

भारत और यूजर्स पर असर (Impact on India)

भारत में AI एजेंट्स के लिए स्पष्ट रेगुलेशन आने से यूज़र्स का भरोसा बढ़ेगा। यह भारतीय स्टार्टअप्स और टेक कंपनियों के लिए एक स्पष्ट दिशा भी प्रदान करेगा कि वे किस तरह के AI उत्पाद विकसित कर सकते हैं। हालांकि, अगर रेगुलेशन बहुत सख्त हुए, तो यह देश में AI अनुसंधान और विकास (R&D) की गति को धीमा कर सकते हैं। इसलिए, सरकार के लिए नवाचार और सुरक्षा के बीच संतुलन बनाना एक बड़ी चुनौती होगी। भारतीय यूज़र्स को भविष्य में अधिक सुरक्षित और भरोसेमंद AI सेवाएं मिलने की उम्मीद है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

AI एजेंट्स ऐसे सॉफ्टवेयर प्रोग्राम होते हैं जो स्वायत्त (Autonomous) रूप से कार्य कर सकते हैं, निर्णय ले सकते हैं और अपने लक्ष्यों को पूरा करने के लिए कार्रवाई कर सकते हैं।

सरकार AI एजेंट्स के संभावित खतरों, जैसे कि डेटा गोपनीयता (Data Privacy) का उल्लंघन और अनपेक्षित परिणामों से निपटने के लिए रेगुलेशन पर विचार कर रही है।

रेगुलेशन का मतलब होगा कि AI एजेंट्स को सुरक्षा मानकों (Safety Standards) का पालन करना होगा और उनके कार्यों की जवाबदेही तय की जाएगी।