Anthropic CEO ने Pentagon के साथ AI प्रोजेक्ट पर रुख सख्त किया

Anthropic के CEO, डैरियो अमोदेई, ने पेंटागन के साथ चल रहे एक महत्वपूर्ण AI प्रोजेक्ट को लेकर अपनी स्थिति स्पष्ट की है। उन्होंने नैतिक चिंताओं के कारण कुछ शर्तों पर समझौता करने से इनकार कर दिया है, जिससे प्रोजेक्ट की समय-सीमा पर दबाव बढ़ रहा है।

Anthropic CEO ने AI सुरक्षा पर रुख सख्त किया

शॉर्टकट में पूरी खबर

कही अनकही बातें

हमारा मुख्य ध्यान यह सुनिश्चित करना है कि हमारे AI सिस्टम सुरक्षित और जिम्मेदारी से विकसित हों, भले ही इसके लिए हमें कुछ सरकारी कॉन्ट्रैक्ट्स पर असहमत होना पड़े।

समाचार विस्तार में पूरी खबर

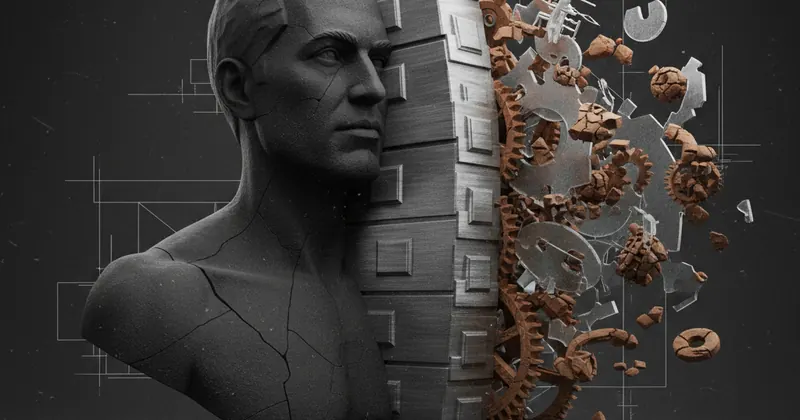

Intro: एंथ्रोपिक (Anthropic), जो OpenAI के प्रमुख प्रतिद्वंद्वियों में से एक है, इस समय एक महत्वपूर्ण मोड़ पर खड़ी है। कंपनी के CEO, डैरियो अमोदेई, ने अमेरिकी रक्षा विभाग (Pentagon) के साथ एक बड़े AI डेवलपमेंट प्रोजेक्ट को लेकर अपनी शर्तों पर मजबूती से टिके रहने का फैसला किया है। यह स्थिति तब उत्पन्न हुई है जब प्रोजेक्ट की अंतिम समय-सीमा नजदीक आ रही है। यह खबर वैश्विक स्तर पर AI गवर्नेंस और राष्ट्रीय सुरक्षा के बीच के तनाव को दर्शाती है, खासकर भारत जैसे देशों के लिए जो AI के नैतिक उपयोग को लेकर चिंतित हैं।

मुख्य जानकारी (Key Details)

Anthropic और Pentagon के बीच चल रहे इस सहयोग का उद्देश्य उन्नत AI सिस्टम विकसित करना है। हालाँकि, CEO अमोदेई ने स्पष्ट किया है कि वे AI सुरक्षा (AI Safety) और नैतिक दिशानिर्देशों (Ethical Guidelines) से समझौता नहीं करेंगे। कंपनी का मानना है कि AI टेक्नोलॉजी का विकास जिम्मेदारी से होना चाहिए, और कुछ विशेष उपयोगों के लिए सख्त नियंत्रण आवश्यक हैं। Pentagon की कुछ मांगें इन सुरक्षा उपायों से टकरा रही थीं, जिसके कारण बातचीत में गतिरोध पैदा हो गया है। अमोदेई ने जोर देकर कहा है कि एंथ्रोपिक अपने Claude AI मॉडल के दुरुपयोग को रोकने के लिए प्रतिबद्ध है, चाहे इसका मतलब प्रोजेक्ट में देरी हो या कॉन्ट्रैक्ट का टूटना ही क्यों न हो। यह कदम AI समुदाय में नैतिक नेतृत्व के एक मजबूत उदाहरण के रूप में देखा जा रहा है।

तकनीकी विवरण (Technical Insight)

इस विवाद का मूल तकनीकी रूप से 'Model Alignment' और 'Red Teaming' प्रोटोकॉल में छिपा है। एंथ्रोपिक यह सुनिश्चित करना चाहता है कि उसके AI मॉडल बाहरी खतरों (adversarial attacks) के प्रति सुरक्षित रहें और विशिष्ट खतरनाक कार्यों (जैसे जैविक हथियार डिजाइन या साइबर हमले) के लिए प्रशिक्षित न किए जाएं। Pentagon की तरफ से शायद ऐसे उपयोगों के लिए कुछ छूट की मांग की गई होगी, जिसे एंथ्रोपिक अपने 'Constitutional AI' फ्रेमवर्क के तहत स्वीकार करने को तैयार नहीं है। यह फ्रेमवर्क AI को कुछ नियमों के आधार पर व्यवहार करने के लिए प्रशिक्षित करता है, जो बाहरी हस्तक्षेपों से प्रभावित नहीं होने चाहिए।

भारत और यूजर्स पर असर (Impact on India)

भारत में, जहाँ सरकार और प्राइवेट सेक्टर तेजी से AI को अपना रहे हैं, एंथ्रोपिक का यह रुख एक महत्वपूर्ण सबक देता है। यह दिखाता है कि तकनीकी प्रगति के साथ-साथ सुरक्षा और नैतिकता को प्राथमिकता देना कितना आवश्यक है। भारतीय टेक इंडस्ट्री को भी अपने AI डेवलपमेंट में इसी तरह की मजबूत नैतिक नींव बनाने की जरूरत है, ताकि भविष्य में डेटा प्राइवेसी और राष्ट्रीय सुरक्षा से जुड़े जोखिमों से बचा जा सके।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

विवाद Anthropic द्वारा विकसित किए जा रहे AI मॉडल के उपयोग और नैतिक सीमाओं को लेकर है। Anthropic कुछ सुरक्षा शर्तों पर समझौता नहीं करना चाहता जो Pentagon मांग रहा है।

यदि दोनों पक्ष किसी समझौते पर नहीं पहुंचते हैं, तो प्रोजेक्ट की निर्धारित समय-सीमा चूक सकती है, जिससे देरी हो सकती है।

Anthropic की मुख्य चिंता यह है कि उनके AI मॉडल का दुरुपयोग न हो, विशेष रूप से रक्षा या निगरानी (surveillance) उद्देश्यों के लिए, और वे इसके लिए सख्त सुरक्षा प्रोटोकॉल चाहते हैं।