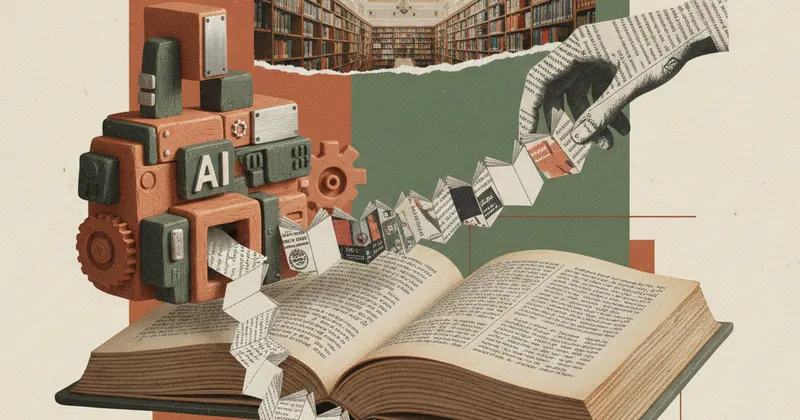

AI मॉडल्स अब किताबों की नकल हूबहू कर सकते हैं

शोधकर्ताओं ने खुलासा किया है कि बड़े भाषा मॉडल (LLMs) अपने ट्रेनिंग डेटा से उपन्यासों की लगभग हूबहू नकल (Near-Verbatim Copy) उत्पन्न कर सकते हैं। यह डेटा गोपनीयता (Data Privacy) और कॉपीराइट उल्लंघन (Copyright Infringement) को लेकर गंभीर चिंताएँ पैदा करता है।

AI मॉडल्स द्वारा साहित्यिक सामग्री का दोहराव चिंता का विषय

शॉर्टकट में पूरी खबर

कही अनकही बातें

यह दिखाता है कि LLMs सिर्फ पैटर्न नहीं सीख रहे हैं, बल्कि वे विशिष्ट टेक्स्ट को याद कर रहे हैं, जो कॉपीराइट के लिए खतरनाक है।

समाचार विस्तार में पूरी खबर

Intro: आर्टिफिशियल इंटेलिजेंस (AI) की दुनिया में एक नई और गंभीर चिंता सामने आई है। हालिया शोधों ने यह खुलासा किया है कि बड़े भाषा मॉडल (Large Language Models - LLMs), जो आज के डिजिटल युग का आधार बन चुके हैं, अपने ट्रेनिंग डेटा से साहित्यिक कृतियों की लगभग हूबहू प्रतियां (Near-Verbatim Copies) उत्पन्न कर सकते हैं। यह खोज विशेष रूप से उन लेखकों और प्रकाशकों के लिए चिंता का विषय है जिनकी रचनाओं का उपयोग इन मॉडल्स को प्रशिक्षित करने के लिए किया गया है। 'टेकसराल' पर हम इस जटिल मुद्दे को सरल भाषा में समझ रहे हैं कि यह कैसे संभव हो रहा है और इसका भविष्य में क्या असर पड़ेगा।

मुख्य जानकारी (Key Details)

यह रिसर्च दर्शाती है कि AI मॉडल्स केवल जानकारी को संश्लेषित (Synthesize) नहीं कर रहे हैं, बल्कि वे विशिष्ट डेटा को मेमोरी के रूप में स्टोर कर रहे हैं। शोधकर्ताओं ने यह प्रदर्शित किया कि कुछ परिस्थितियों में, एक साधारण प्रॉम्प्ट (Prompt) के माध्यम से, एक AI मॉडल किसी उपन्यास के पूरे पैराग्राफ या यहां तक कि अध्याय को सटीकता के साथ दोहरा सकता है। यह तब होता है जब मॉडल ट्रेनिंग डेटा में मौजूद सामग्री के साथ 'ओवरफिट' हो जाते हैं। यह स्थिति सीधे तौर पर कॉपीराइट कानूनों को चुनौती देती है, क्योंकि यह मूल सामग्री के अनधिकृत पुनरुत्पादन (Unauthorized Reproduction) की ओर इशारा करता है। विभिन्न टेक कंपनियों द्वारा अपने AI मॉडल्स को प्रशिक्षित करने के लिए उपयोग किए जाने वाले विशाल डेटासेट में अक्सर कॉपीराइट सामग्री शामिल होती है, और यह शोध उस जोखिम को उजागर करता है।

तकनीकी विवरण (Technical Insight)

तकनीकी रूप से, यह प्रक्रिया 'मेमोराइजेशन' (Memorization) के कारण होती है। जब एक न्यूरल नेटवर्क (Neural Network) को बहुत अधिक डेटा खिलाया जाता है, तो यह डेटा में मौजूद शोर (Noise) और विशिष्टता दोनों को याद करने लगता है। यदि कोई उपन्यास डेटासेट में बार-बार आता है या बहुत लंबा है, तो मॉडल उस विशिष्ट क्रम को आंतरिक पैरामीटर्स में एन्कोड कर लेता है। जब यूज़र किसी विशिष्ट प्रॉम्प्ट का उपयोग करता है, तो मॉडल उस एन्कोड किए गए डेटा को आउटपुट के रूप में वापस निकाल देता है। इसे रोकने के लिए 'डिफरेंशियल प्राइवेसी' (Differential Privacy) जैसी तकनीकों का उपयोग किया जाता है, लेकिन ये तकनीकें अभी भी पूरी तरह से प्रभावी नहीं मानी जा रही हैं।

भारत और यूजर्स पर असर (Impact on India)

भारत, जो AI विकास और उपयोग में तेजी से आगे बढ़ रहा है, के लिए यह मुद्दा महत्वपूर्ण है। भारतीय लेखकों और कंटेंट क्रिएटर्स को यह सुनिश्चित करने की आवश्यकता होगी कि उनके काम का उपयोग AI ट्रेनिंग के लिए उचित लाइसेंसिंग (Licensing) के तहत हो। यूज़र्स के दृष्टिकोण से, यह सवाल उठता है कि क्या वे जिस AI कंटेंट का उपयोग कर रहे हैं, वह किसी अन्य की बौद्धिक संपदा (Intellectual Property) का उल्लंघन तो नहीं है। भारत सरकार और टेक इंडस्ट्री को AI के नैतिक उपयोग (Ethical Use) और डेटा सुरक्षा के लिए मजबूत नीतियां बनाने की जरूरत है।

🔄 क्या बदला है?

पहले क्या था और अब क्या अपडेट हुआ — तुलना एक नज़र में।

समझिए पूरा मामला

जब AI मॉडल को बहुत बड़े डेटासेट पर प्रशिक्षित किया जाता है, तो वे डेटा में मौजूद पैटर्न और टेक्स्ट को याद कर लेते हैं। यदि कोई टेक्स्ट बार-बार दोहराया जाता है, तो मॉडल उसे हूबहू उत्पन्न कर सकता है।

हाँ, यदि AI द्वारा उत्पन्न टेक्स्ट मूल रचना के महत्वपूर्ण हिस्से को दोहराता है, तो इसे कॉपीराइट उल्लंघन माना जा सकता है, खासकर यदि मॉडल को प्रशिक्षित करने के लिए सामग्री का उपयोग बिना अनुमति के किया गया हो।

शोधकर्ता अब 'डेटा डीनॉइज़िंग' और प्रशिक्षण के दौरान 'ओवरफिटिंग' को कम करने के लिए नए तरीके विकसित कर रहे हैं ताकि मॉडल विशिष्ट टेक्स्ट को याद करने के बजाय सामान्य पैटर्न सीखें।